本章将深入探讨机器智能感知的基础理论和关键技术。3.1节将介绍机器视觉的基本概念,理解其核心特性,这些是机器智能感知的基础。通过学习机器视觉的基本概念和特性,读者将掌握机器视觉系统的基本原理。

3.2节将详细讲解机器视觉感知技术。首先探讨机器视觉系统中的图像传感技术;然后学习用于移动机器人的仿生实时视觉感知方法;最后介绍用于机器人的多传感器融合感知技术。通过这些内容的学习,读者将了解机器视觉感知的核心技术和实现方法。

3.3节将探讨视觉智能感知的应用。通过具体的应用实例,读者将了解机器视觉技术在实际场景中的运用,加深对机器智能感知系统的理解。

通过本章的学习,读者将系统掌握机器智能感知的基础理论和核心技术,了解从基本概念到具体应用的完整知识体系。

机器视觉是一种或多种传感技术和计算机技术相结合的术语。从根本上说,传感器(通常是遥视型摄像机)从场景中获取电磁能量(通常是可见光谱,即光),并将能量转换为计算机可以使用的图像。计算机从图像中提取数据(通常首先增强或处理数据),将数据与先前制定的标准进行比较,并通常以相应的形式输出结果 [ 1 ] 。

机器视觉,即基于计算机的图像分析和解释的应用,是一种已经被证明可以显著提高生产效率和制造质量的技术,包括图像处理、机械工程技术、控制、电光源照明、光学成像、传感器、模拟与数字视频技术、计算机软硬件技术(图像增强和分析算法、图像卡、I/O卡等)。在某些行业(半导体、电子、汽车),许多产品的生产离不开机器视觉,因为机器视觉是生产线上不可或缺的技术。一个典型的机器视觉应用系统包括图像捕捉模块、光源系统、图像数字化模块、数字图像处理模块、智能判断决策模块和机械控制执行模块 [ 2 ] 。

根据自动化成像协会(Automated Imaging Association,AIA)的说法,机器视觉应用包括工业和非工业两种,在这些应用中,硬件和软件的组合为基于图像捕获和处理的设备执行其功能提供操作指导。尽管工业机器视觉使用了许多与学术/教育、政府/军事机器视觉应用相同的算法和方法,但约束是不同的。与学术/教育视觉系统相比,工业视觉系统需要更强的鲁棒性、可靠性和稳定性,而且成本通常比政府/军事应用的视觉系统要低得多。因此,工业机器视觉意味着低成本、可接受的精度、高鲁棒性、高可靠性、高机械稳定性和温度稳定性 [ 3 ] 。

机器视觉系统(Machine Vision System,MVS)依靠工业相机内的数字传感器来获取图像,从而使计算机硬件和软件能够处理、分析和检测各种特征,以便做出决策 [ 4 ] 。例如,考虑一个啤酒厂的灌装水平检测系统,每一瓶啤酒都经过一个检测传感器,它触发一个视觉系统闪光灯,并为瓶子拍照。在获取图像并将其存储在内存中后,视觉软件对其进行处理或分析,根据瓶子的灌装水平发出通过/失败响应。如果系统检测到一个灌装不当的瓶子,它会发出信号,通知转喷器拒绝这个瓶子,操作员可以在显示器上查看被拒绝的瓶子和正在进行的工艺统计数据。机器视觉系统还可以进行客观测量,如确定火花塞间隙或提供位置信息,以指导机器人在制造过程中对齐目标。

了解机器视觉所处的创新周期阶段尤为重要。机器视觉的发展通常可分为研究、早期商业化、特定生态位产品、广泛扩散四个阶段 [ 5 ] 。

在研究阶段,该领域的专家向该领域提供新的知识。在早期商业化阶段,研究人员开发的产品更像是“寻找问题的解决方案”,使用这些产品需要大量的专业知识。应用第二阶段(早期商业化)技术的个人通常是靠开拓创新而茁壮成长的技术人员。第三阶段(特定生态位产品)出现了特定的产品,有人认为这是机器视觉现在所处的阶段。嵌入生产设备的机器视觉系统通常对设备操作员完全透明:特定应用程序的机器视觉系统通常有一个图形用户界面,便于操作员使用。第四阶段(广泛扩散)的特点是技术透明——用户除了知道它有用之外,对它一无所知。大多数汽车驾驶员对汽车的操作原理了解甚少,除了你转动钥匙时它会做什么。有趣的是,当汽车采用“第二阶段”技术时,由于经常发生故障,驾驶员还必须能够对其进行维修。从那时起,服务站和高速公路的基础设施已经出现,以支持这项技术。随着行业中的机器视觉从第二阶段进入第四阶段,行业得到了整合。

当前,机器视觉技术是否会无形地融入人们的日常生活还有待观察。但可以预见的是,作为支撑机器视觉的底层核心技术,很快将进入第四阶段——发展阶段,成为普遍应用的关键技术。

特别是在生物识别领域,由于广泛采用了与机器视觉相同的计算机视觉技术,它在不久的将来很可能成为人们访问自动柜员机、兑现支票、登录计算机系统等场景中的主要认证手段,为人们的日常生活带来全新的体验。毫无疑问,潜在技术将在其他市场普及,例如计算机视觉的应用使汽车自动驾驶成为可能。

机器视觉技术如同历史上出现的各类技术方法一样,有其优势,也有其劣势,只有充分地了解它、掌握它,才能恰当地运用它,快速方便地解决存在的技术问题,为国家和社会所用,降低成本,提高效率,从而使人们的生活变得更安全、更舒适、更快捷。

人类视觉最适合对复杂、非结构化场景进行定性解释,而机器视觉则擅长于对结构化场景进行定量测量,这是由于它具有高速性、准确性和可重复性 [ 6 ] 。例如在生产线上,机器视觉系统每分钟可以检查数百甚至数千个目标。一个建立在正确的相机分辨率和光学周围的机器视觉系统可以很容易地检查出肉眼无法看到的物体细节。通过消除测试系统和被测试部件之间的物理接触,机器视觉可以防止部件损坏,并消除与机械部件磨损相关的维护时间和成本。机器视觉通过减少人类在制造过程中的参与,带来了额外的安全和操作效益。此外,它防止了无菌环境下的人类污染,保护工人免受危险环境的影响。机器视觉技术的特性主要表现在以下方面 [ 7 ] :

1.非接触性

最传统的检测方法是“眼看、手摸脚行”。“眼看”就是使用非接触的方法,“手摸脚行”使用的是接触法,必须与被检测物直接或间接接触才能检测。机器视觉技术就是典型的非接触检测,通过机器用“看”的方法检测。

2.高敏感性

(1)更加宽阔的光谱范围 眼睛只能看见可见光,其波长在400~760nm,其他波长下的光肉眼无法直接观察。而机器视觉借助光电等方法可以看见可见光、紫外线(100~400nm)、红外线(760nm~0.3mm)、X射线(0.001~100nm)等,拓宽了可视范围。例如,电荷耦合器件(Charge Couple Device,CCD)相机的光谱响应范围为400~1100nm。

(2)更加深入的分辨力 黑白相机的像素深度有8bit、10bit和12bit。8bit像素深度对应于0~255级,肉眼最多只能分辨40级左右(不同性别、年龄、肤色等略有不同),可识别约0.1mm宽度以上的裂痕缺陷,而机器视觉技术则可提高分辨力10~100倍以上。机器视觉技术具有更深入的分辨力,能够观察更加微小的细节。

(3)更快捷的响应速度 眼睛内部的神经传导响应时间约为40ms,使眼睛可观察移动速度为1m/s以下的物体细节,移动速度超过1m/s的物体眼睛无法观察其细节。而线阵工业相机的行频通常为几千赫兹,最快可达数十万赫兹,因此可以观测到速度更快的物体。

3.高适应性

机器视觉就像一台机器,可以根据不同的工况环境条件做不同的设计,高度适应工况,如高温、高湿、压力、粉尘、振动、电磁、易燃易爆、高危、高强度、高重复性等较为恶劣的工况。

4.一定的鲁棒性

机器视觉具有一定的鲁棒性,能够满足不同类别的使用。从另一角度来讲,当你越过技术门槛之后,机器视觉系统的基本原理都是相通的,系统构成大同小异,从这个角度来讲其鲁棒性很强。

5.快速发展的智能性

随着计算性能的提高,光电技术、图像算法、控制机制、大数据存储与传输及仿生学、神经学、心理学、工程数学等科学技术的快速发展,机器视觉越来越具备人类的智慧,更加有效、智能地服务于人类客户。

6.易集成性

机器视觉系统易实现信息如设计信息、制造信息和检测信息等的集成及管理,为工厂信息集成系统提供技术保证和支撑。

7.高精度

选用高精度的图像传感器,匹配高精度的图像算法,对机器视觉系统进行优化设计,从而实现更高精度的测量、识别和定位。

8.经济性

虽然机器视觉经过国内外众多研究人员的总结,但至今为止仍未形成一套完整的技术理论和技术体系,因此构造一套机器视觉系统需要多专业综合技术与实际应用充分地结合。对于大型工程项目来说,机器视觉系统周期更长、投入更多,见效也较慢。

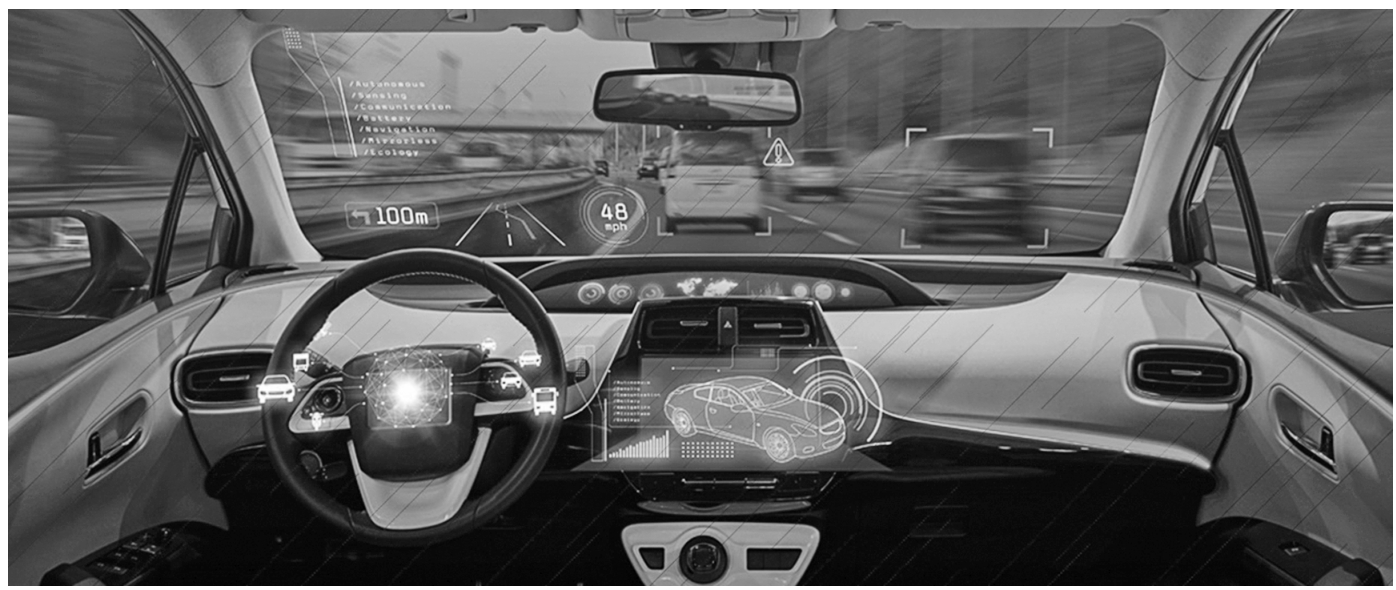

与传统的照相技术相比,数码相机具有许多优势,包括无须处理胶片、易于编辑和经济实惠等。其所采用的数字成像技术也扩展到手机、笔记本计算机、安防监控、汽车、医疗和娱乐行业等。数码相机还广泛用于机器视觉系统的图像捕获中 [ 8 ] ,它依赖目标识别和图像分析来提取数据,然后用于控制过程或活动。机器视觉系统的应用范围很广,从自动化工业应用(如产品的检测和质量评估),到机器人引导和控制、自动驾驶汽车、精密农业中的葡萄栽培、采摘和分拣、比色分拣系统等。尽管传统的图像传感器通常被认为能够满足消费者数码摄影的需求,但在高精度和快速彩色图像捕获的机器视觉系统应用所需的成像水平时受到限制,通常出现在具有大动态光照范围的不受控制的照明场景中。此外,考虑到诸如自动驾驶汽车、军事应用、机器人中的成像条件,研究人员正在研究寻找具有所需尺寸、亮度、柔性和小型化基板兼容性的光电检测系统,从而降低成本。为了尝试满足这些要求,可以对传感系统进行修改,包括使用不同的光电探测器材料和图像处理技术、更改分色系统的设计和布置、调整图像传感器架构或单个像素传感器布置(通常是被动或主动)或将“智能功能”集成到图像传感器的芯片上。图3.1演示了自动驾驶系统的计算机视觉功能,用于检测和分类驾驶环境中的不同元素,例如车辆、车道标记、障碍物和道路边界。这种视觉感知对于自动驾驶应用中的安全导航、避障和决策至关重要。

图3.1 自动驾驶汽车采集到的图像

随着机器人不断融入人们的日常生活中,商用移动机器人的数量也在逐渐增加。移动机器人执行诸如监视、清洁或帮助残疾人等任务。然而,要使这些机器人能够可靠地感知其环境中的物体和事件,并具有令人满意的自主性,因此设计适合导航相关任务的传感器变得尤为重要。

如今,相机被认为是机器人技术中最轻便、最实惠的视觉传感器。它能够被动地捕获大量的视觉数据,同时反映所观察场景的光度和几何特性,但其运行需要很强的计算能力,并且受限于所使用传感器的固有限制。单目相机的视野有限,仅提供观察到的特征角度,但没有范围信息。立体相机可以测量未知场景中的深度,但它们的视野也是有限的。

然而,随着物种的进化,自然界已经存在完全适合特定物种需求的视觉感知系统,其中一些令人难以置信,例如飞虫的视觉感知。这些昆虫具有宽阔的视野和复杂的眼睛,使它们能够有效地导航。类似地,一些移动机器人使用全方位摄像头,从单一视图感知整个环境,此类摄像头可确保机器人在合理的时间内收集有关环境的必要信息 [ 9 ] 。遗憾的是,仅使用全方位摄像头的数据来计算机器人或物体的位置并不容易。更复杂的动物通过发展出周边视觉和中央凹视觉,大脑可以利用这两种系统的线索正确解释环境。然而,距离的准确感知需要中心凹分析,需要两个或多个场景视图来生成未知物体的3D位置,这在动物中是可以实现的。

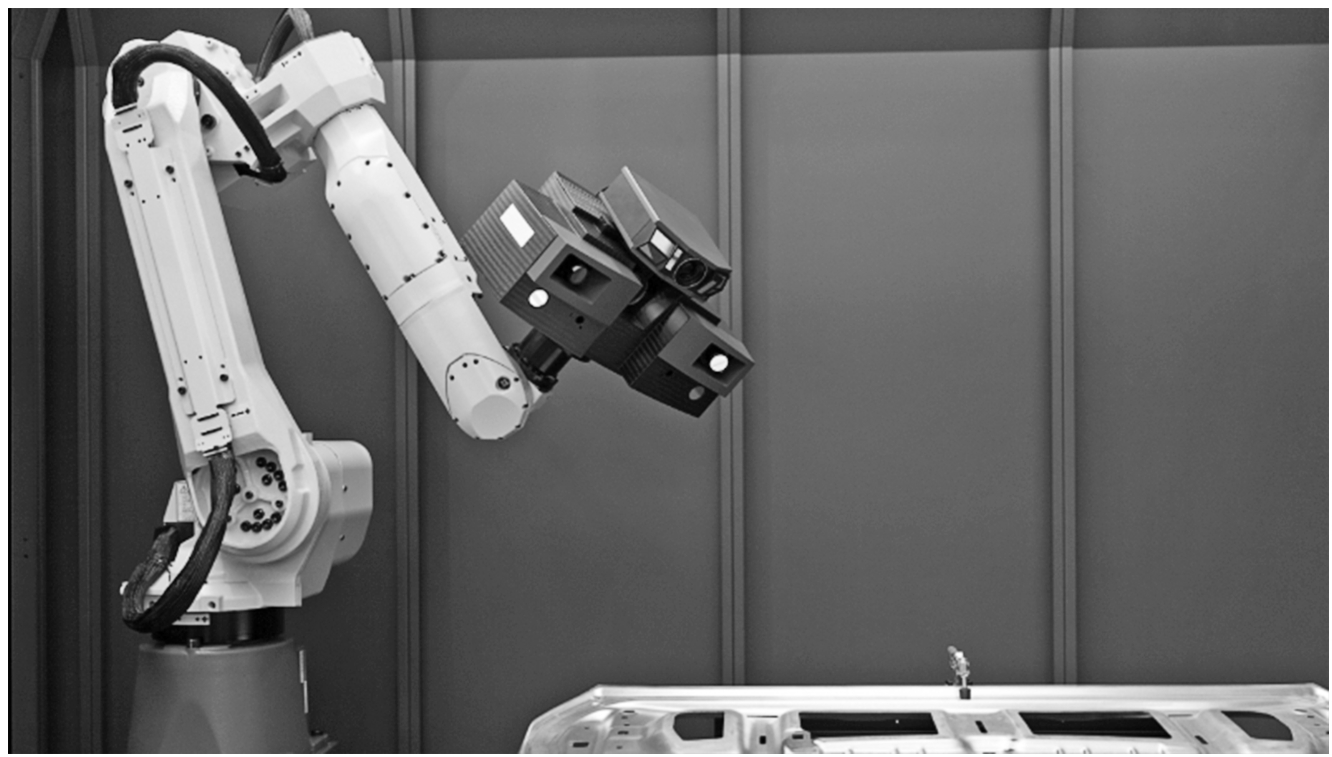

遵循最有效的生物视觉示例,研究者在构建的过程中结合全向和中心凹视觉机制,并通过这种方式提供了一个系统,它结合了两种相机类型的优点:360°视野和准确的环境数据(机器人和物体的位置)。如图3.2所示,通过将看向曲面镜的相机和安装在该镜子顶部的典型透视相机相结合,创建了具有混合视野的视觉传感器,并在伺服系统上安装了透视相机。通过这种设计,透视相机可以水平旋转,以实现跟踪对象的功能,从而可以主动选择透视相机的视野。

图3.2 移动机器人的仿生视觉传感

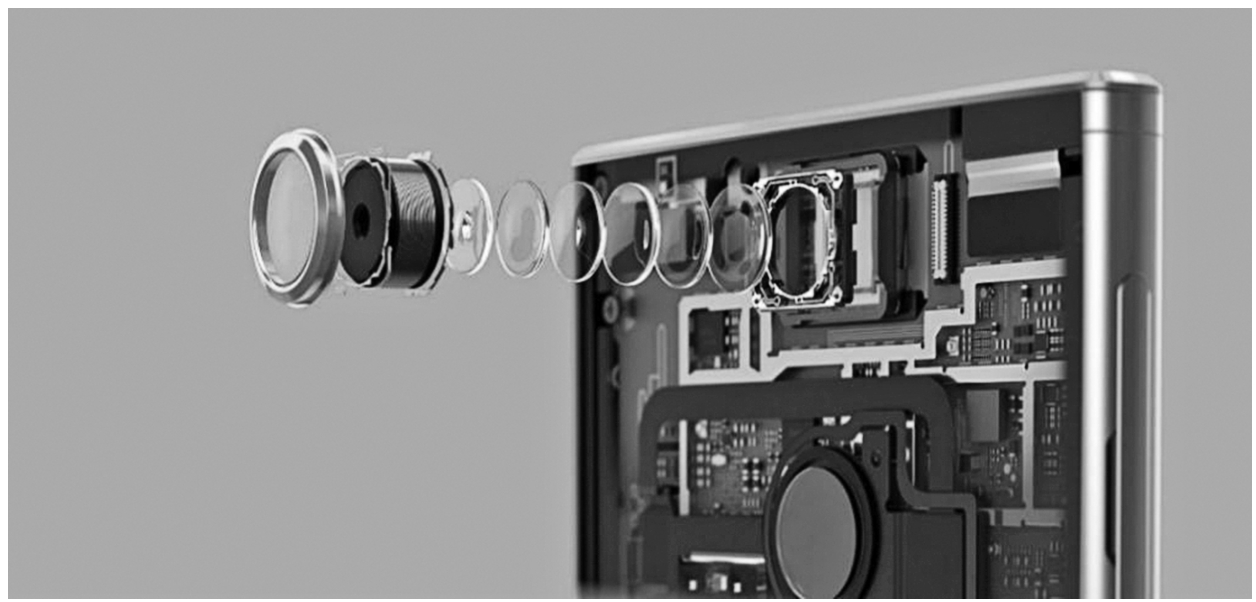

传统视觉技术将3D世界的信息投影到2D平面上,因此缺少场景的深度信息,而获取深度信息对于捕捉真实世界空间至关重要。因此,3D视觉系统成为机器人和自主系统的重要研究课题 [ 10 ] 。例如,路径规划和避障是实现自动驾驶汽车的核心问题,并且在很大程度上依赖于为系统准确性提供态势感知的传感器。大量关于安全和避障的研究正在进行,3D视觉技术仍然是机器人系统的一个重要组成部分。毫不奇怪,除了通常的红、绿、蓝(RGB)颜色视觉之外,大多数先进的机器人视觉系统已经使用RGB-D视觉技术部署了一种主动或被动深度信息形式,其中D代表深度。在机器人技术中,基于飞行时间(Time of Flight,TOF)的传感器与立体视觉系统一起被广泛用于提取深度信息。TOF传感器特别适用于自动驾驶汽车和自动航空系统或无人机,基于TOF的深度传感器是最有前途的远程主动深度传感形式,德州仪器、索尼、松下、意法半导体、AMS等科技巨头目前正在开发与智能手机等便携式设备兼容的用于距离成像的微深度传感器,如图3.3所示,智能手机的摄像头已经普遍采用了TOF深度传感器,可以极大提高相机的性能。

图3.3 智能手机摄像头采用的TOF深度传感器

实时物体识别是机器人视觉另一个活跃的研究领域,使用RGB-D传感器进行3D物体重建很常见。体素中包含的信息用于比较和识别其中包含的不同对象和特征,这种方法的优势在于可以从3D空间中提取大量显著特征以提高对象识别性能。目前,市场上存在许多商用3D图像传感器,成像系统供应商正在开发新一代3D图像传感器。监控系统、车辆识别、交通控制系统、人数统计系统、活动和手势识别等是该类别的子域,其中3D信息可提高系统效率。访问深度信息对计算机图形学有很大影响,尤其是在游戏、图像检索以及考古学中。

在医疗机器人中,深度信息对分配感知有很大影响 [ 11 ] 。在计算机辅助手术(Computer Aided Surgery,CAS)或机器人辅助微创手术(Minimally Invasive Surgery,MIS)中,深度信息具有重要作用。在传统的MIS中,3D手术世界被投影到2D屏幕上,因此,执行MIS的外科医生需要面临更多挑战:外科医生必须在2D空间中完成3D世界中的操作,并且缺少触觉信息,使MIS系统更加复杂。在MIS背景下,视力是改善手术结果(安全性和意外伤害)的最关键因素。如果没有深度信息,MIS就难以在手术空间内跟踪手术工具。最近的研究表明,当3D视觉被纳入跟踪系统时,通过呈现3DMIS与2DMIS的综合结果,MIS程序有了显著的改进。根据他们的记录,3D手术与2D手术中MIS的中位误差分别为27和105,报告的中位误差减少了25.72%。另一项研究表明,3DMIS减少了71%的执行时间以及63%的错误率。因此,3D视觉系统在缺乏经验丰富的外科医生的国家中有着巨大的优势。

在全球范围内,机器视觉已成为制造业自动化视觉检测的流行工具。在印度,由于系统集成专业知识和对技术的理解增强,机器视觉工具的采用率大幅增加。随着人工智能的最新进展、计算能力的增强以及算法开发的进步,机器视觉已经以基于深度学习的检测系统的形式呈现出新的形象。当涉及“教”机器寻找指定目标时,这些系统易于训练,并降低了集成复杂性。

然而,重要的是要从功能上理解这项技术如何应用于制造。有许多不同的应用程序组,重要的是要了解用户的需求属于哪种应用程序,以便决定用户需要投资哪种系统设计和技术。通常,需要根据用户的应用程序制定一个(甚至更多)功能需求,下面列出了4个主要功能需求 [ 12 ] 。

(1)目标检测 这里的目标是定位或检测给定图像中是否存在感兴趣的目标。例如图3.4中通过机器视觉很好地检测出狗、自行车和汽车。视觉系统仅通过预先训练的“黄金图像”或“模式”进行识别,并将其与来自相机的实时图像进行比较。

图3.4 视觉目标检测和识别在生活中的应用

(2)缺陷检测 缺陷检测应用程序检测产品表面上的异常,例如表面缺陷、凹痕和划痕。缺陷检测应用需要精细化和客观化,以确保可以将可接受的缺陷与不可接受的缺陷区分开来。使用基于人工智能的机器视觉非常适合这些应用,因为系统是基于示例而不是“规则”的。

(3)打印缺陷识别 识别印刷异常,如不正确的颜色深浅或部分印刷品缺失或瑕疵,是印刷缺陷识别的目标。在这些应用程序中,系统会训练主图像,以识别与该主图像的任何偏差。

(4)定位 定位物体是机器视觉在机器人引导等应用中的常见用途。这里机器视觉系统的目标是定位感兴趣对象的坐标/位置。该信息可用于拾取对象或执行其他依赖于该位置的过程。这种类型的机器视觉应用,需要将感兴趣的部分传授给机器视觉系统,在生产过程中识别该部分。

通常,在任何机器视觉应用程序中,无论是最简单的装配验证还是复杂的3D机器人拣箱,第一步都是使用模式匹配技术,在相机的视场中找到感兴趣的物体或特征。如果模式匹配软件工具不能精确定位图像中的目标,那么它就不能指导、识别、检查、计数或测量目标。虽然找到一个目标听起来很简单,但在实际生产环境中,其外观的差异可能会使这一步骤极具挑战性。尽管视觉系统经过训练可以根据模式识别目标,但即使是最严格控制的过程也允许目标的外观存在一些变化。

为实现高精度、稳定可靠和结果可重复,机器视觉系统中的目标定位是第一个且关键的环节。它需要拥有足够智能的定位算法,能够快速精准地将预先训练的模板与待检测物体进行匹配对比。

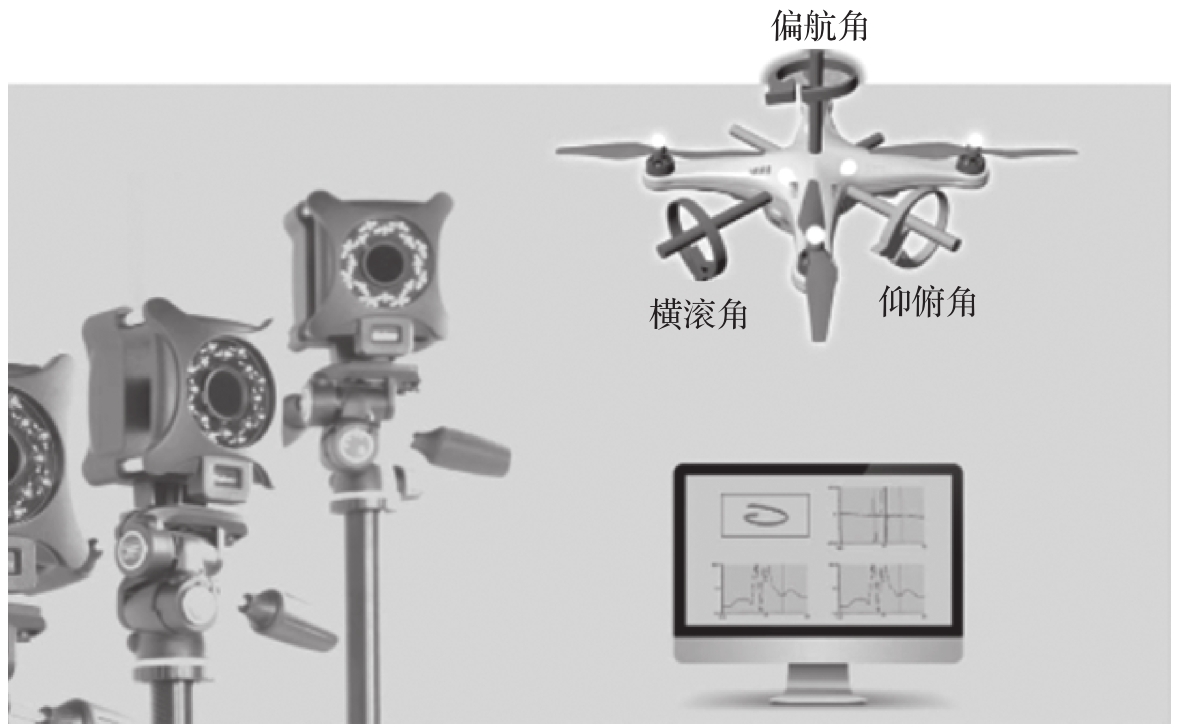

这一点可以从图3.5所展示的无人机光学三维动作捕捉系统中得到印证。该系统集成了伺服角、棱镜角和摄像角等多个模块,其核心目标是实时精准获取无人机在三维空间中的运动轨迹数据。要实现这一目标,系统就必须首先快速准确地定位和锁定无人机目标,并基于先进的目标定位和运动捕捉算法持续跟踪无人机的运动状态。这种对目标物体精准定位的高度要求,正印证了文中所阐述的机器视觉目标定位是第一道且关键的环节。只有拥有智能化的高精度目标定位能力,机器视觉系统才能为后续的识别、检测、测量等高级应用奠定坚实的基础。

图3.5 无人机光学三维动作捕捉系统

在工业机器视觉领域,应用任务通常可分为四大类:引导控制、目标识别、尺寸测量和缺陷检测。

(1)引导控制 首先,机器视觉系统可以定位目标的位置和方向,将其与指定的公差进行比较,并确保其处于正确的角度,以验证正确的装配。接下来,可以使用引导控制的方法将目标在2D或3D空间中的位置和方向报告给机器人或机器控制器,允许机器人定位目标或机器对目标进行对齐。机器视觉导航在安排托盘上或下的部件、从传送带上包装部件、寻找并对准部件以便与其他部件组装、将部件放置在工作架上或从桶中取出部件等任务中,比人工定位的速度和精度要高得多。

引导控制也可以用于对准其他机器视觉工具,这是机器视觉一个非常强大的功能,因为在生产过程中,部件可能以未知的方向呈现给摄像机。通过定位目标,然后对准其他机器视觉工具,机器视觉可以实现自动工具夹具。这包括定位目标上的关键特征,以精确定位卡尺、斑点、边缘或其他视觉软件工具,以便它们正确地与目标交互。这种方法使制造商能够在同一条生产线上生产多个产品,并减少了在检验过程中维护目标位置所需的昂贵的硬模具。

有时引导控制需要几何模式匹配。模式匹配工具必须能够容忍对比度和光照的巨大变化,以及比例、旋转和其他因素的变化,同时每次都能可靠地找到目标。这是因为通过模式匹配获得的位置信息可以使其他机器视觉软件工具对齐。

(2)目标识别 使用机器视觉进行识别涉及识别目标或产品,以便在整个制造或物流过程中跟踪该目标或验证是否正在生产正确的目标。识别可以通过光学字符识别(Optical Character Recognition,OCR)或条形码来完成。用于目标识别的机器视觉系统可以读取条形码(1D)、数据矩阵编码(2D)、直接目标标记(Direct Part Marking,DPM)和打印在目标、标签和包装上的字符。光学字符识别系统读取字母数字字符,而光学字符验证(Optical Character Verification,OCV)系统确认字符串的存在。此外,机器视觉系统可以通过定位一个独特的图案来识别目标,或者根据颜色、形状或大小来识别物品。

DPM应用程序直接在部件上标记代码或字符串。所有行业的制造商普遍使用这种技术来防错、实现有效的遏制策略、监控过程控制和质量控制指标,以及量化工厂中的问题区域(如瓶颈)。直接部件标记提高了资产跟踪和部件真实的可追溯性。它还提供单位级别的数据,通过记录组成成品的装配部件的系谱来驱动卓越的技术支持和保修维修服务。

传统的条形码已被广泛用于零售结账和库存控制。然而,可追溯性信息需要的数据比标准条形码所能容纳的要多。为了增加数据容量,开发了二维代码如数据矩阵,它可以存储更多的信息,包括制造商、产品标识、批号,甚至几乎任何成品的唯一序列号。

(3)尺寸测量 测量应用涉及准确确定物体尺寸的问题。这是通过定位图像上的某些点并从该图像测量几何尺寸(距离、半径、直径、深度等)来完成的。此类应用的示例有测量发动机气缸孔的内径,测量瓶子内的液体填充水平,可以使用2D或3D相机进行测量。

用于测量的机器视觉系统计算物体上两个或多个点之间的距离或几何位置,并确定这些测量是否符合规格。如果不符合规格,视觉系统向机器控制器发送失败信号,触发拒绝机制,将物体从线路中弹出。

在实际操作中,固定安装的相机在物体通过相机视野时捕捉图像,系统使用软件计算图像中各个点之间的距离。由于许多机器视觉系统可以测量物体特征到0.0254mm以内,它们解决了许多传统上用接触测量处理的应用。

(4)缺陷检测 用于缺陷检测的机器视觉系统可以检测出厂产品中的缺陷,如污染物、功能缺陷和其他不正常现象。例如检查药片的缺陷,检查显示屏以验证图标或确认像素的存在,检查触摸屏的背光对比度。机器视觉还可以检查产品的完整性,例如在食品和制药行业中,确保产品和包装之间的匹配,检查瓶子上的安全密封、瓶盖和环是否合规。

1.简述机器视觉的基本概念。

2.机器视觉有哪些特性,请简要说明。

3.机器视觉有哪些感知技术?

4.通过查阅文献的方法,列举三种视觉智能感知的应用。

5.在制造业中,机器视觉应用有哪些类别,请简要说明。

6.在制造业中,四大类机器视觉应用是什么?

7.谈谈你对机器视觉的理解。

[1]JAIN R,KASTURI R,SCHUNCK B G.Machine vision[M].New York: McGraw-hill,1995.

[2]段峰,王耀南,雷晓峰,等.机器视觉技术及其应用综述[J].自动化博览,2002,19(3):59-61.

[3]PATRICK M,君谦.关于边缘工业机器视觉应用发展的调研[J].单片机与嵌入式系统应用,2020,20(1):4-6.

[4]GOLNABI H,ASADPOUR A.Design and application of industrial machine vision systems[J].Robotics and computer-integrated manufacturing,2007,23(6): 630-637.

[5]SERGIYENKO O,FLORES-FUENTES W,MERCORELLI P.Machine vision and navigation[M].Berlin: Springer.2020.

[6]HORNBERG A.Handbook of machine vision[M].Hoboken: John Wiley & Sons,2006.

[7]DAVIES E R.Machine vision: theory,algorithms,practicalities[M].San Francisco: Morgan Kaufmann Publishers,2004.

[8]BECK J,HOPE B,ROSENFEID A.Human and machine vision[M].New York: Academic Press,2014.

[9]GUO J,CHEN P,JIANG Y,et al.Real-time object detection with deep learning for robot vision on mixed reality device[C]//2021 IEEE 3rd Global Conference on Life Sciences and Technologies(LifeTech).New York: IEEE,2021: 82-83.

[10]YANG R,MO Q,LI Y,et al.Application of 3D vision intelligent calibration and imaging technology for industrial robots[J]//Journal of physics: conference series,2021,2082(1): 12004.

[11]LEE Y C,SYAKURA A,KHALIL M A,et al.A real-time camera-based adaptive breathing monitoring system[J].Medical & biological engineering & computing,2021,59(6): 1285-1298.

[12]SOINI A.Machine vision technology take-up in industrial applications[C]// Proceedings of the 2nd International Symposium on Image and Signal Processing and Analysis.Pula: IEEE,2001: 332-338.