本实例为读者详细讲解如何使用文生图来绘制皮克斯动画风格的女孩图像,图2-25所示为本实例制作完成的图像结果。需要注意的是,由于人工智能绘制的随机性特点,即使输入相同的提示词也不会得到与本实例一模一样的图像结果,但是可以得到风格较为相似的图像结果。

图2-25

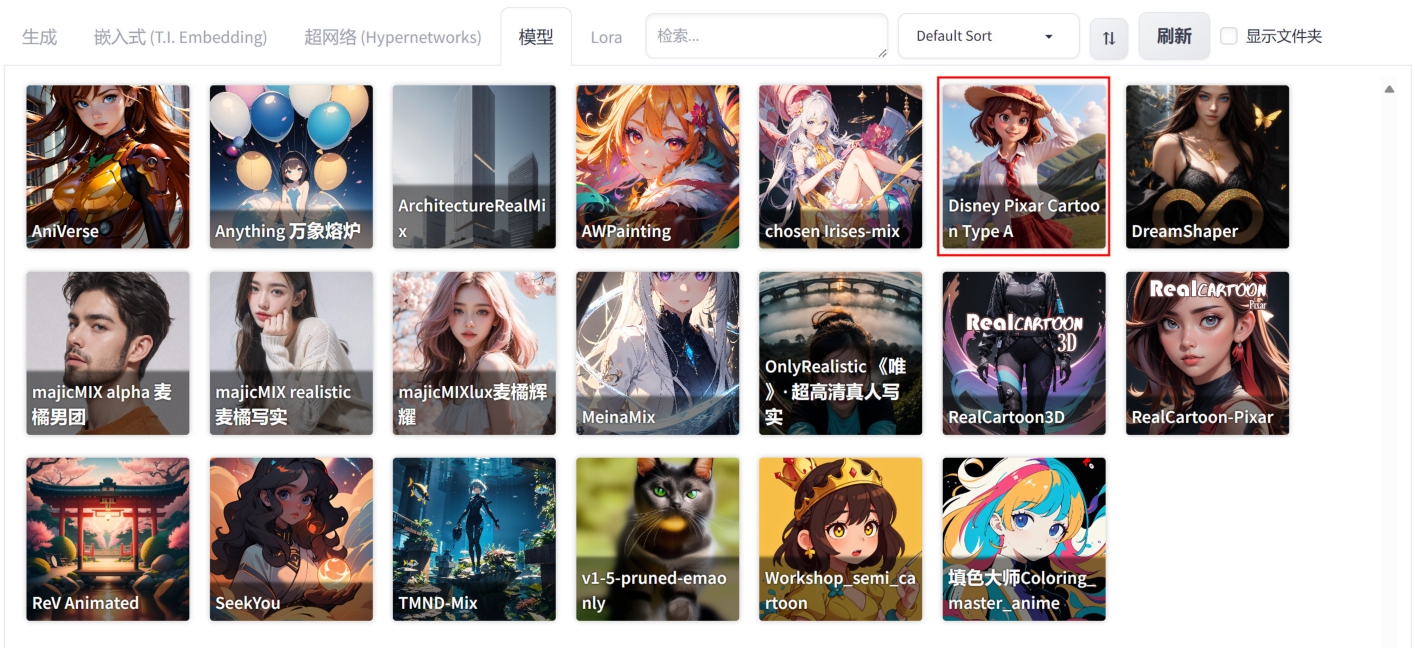

01 在“模型”选项卡中,单击“Disney Pixar Cartoon Type A”模型,如图2-26所示,将其设置为“Stable Diffusion模型”。

图2-26

02 设置“外挂VAE模型”为“vae-ft-mse-840000-ema-pruned.safetensors”,并在“文生图”选项卡中输入中文提示词“1女孩,微笑,格子领带,红色格子,红裙子,白色衬衫,手表,黑色头发,斜挎包,户外,植物,山脉,杰作,最好质量”后,按Enter键则可以生成对应的英文“1girl,smile,plaid_necktie,red grid,red_skirt,white shirt,wristwatch,black hair,messenger_bag,outdoors,plant,mountain,masterpiece,best quality,”,如图2-27所示。

图2-27

由于Stable Diffusion单机版和在线版内置的翻译软件不同,所以本书中所有案例的提示词应以英文为准,读者输入中文提示词后需要再仔细核对生成的英文提示词。

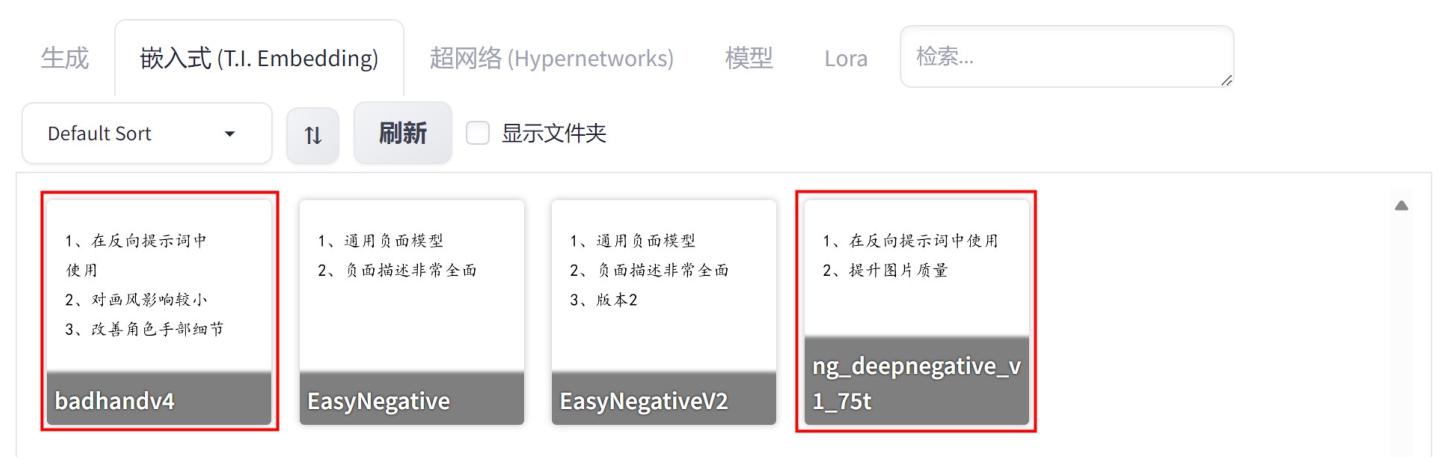

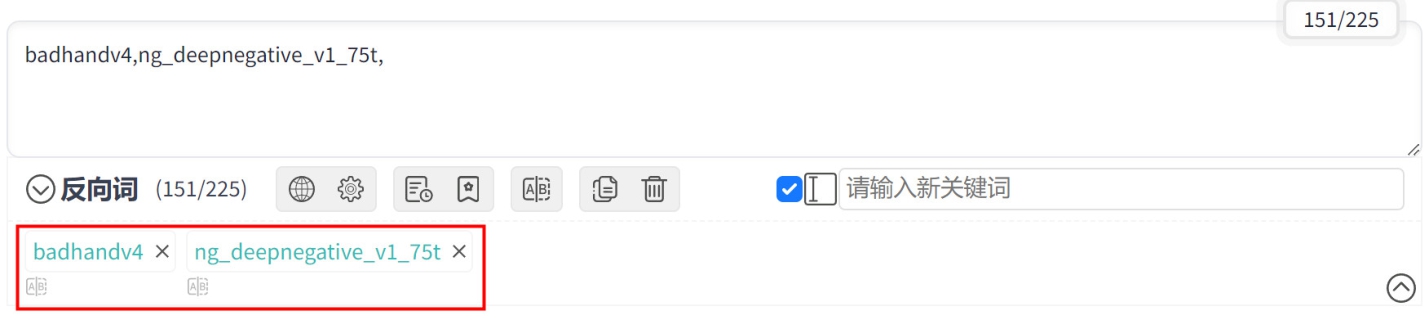

03 在“嵌入式(T.I.Embedding)”卷展栏中,单击“badhandv4”和“ng_deepnegative_v1_75t”模型,如图2-28所示,将其添加至反向词文本框中,如图2-29所示。

图2-28

图2-29

04 在ADetailer卷展栏中勾选“启用After Detailer”复选框,如图2-30所示。

图2-30

05 在“生成”选项卡中,设置“迭代步数(Steps)”为30、“高分迭代步数”为20、“放大倍数”为1.5、“宽度”为700、“高度”为1000、“总批次数”为4,如图2-31所示。

图2-31

06 设置完成后,绘制出来的效果如图2-32所示。

图2-32

“Disney Pixar Cartoon Type A模型”的作者提示:该模型需配合“外挂VAE模型”使用,如设置“外挂VAE模型”为None(无),会得到颜色偏灰的图像,如图2-33所示。

图2-33

AI绘画可以根据文字快速生成图像,尤其是在一些角色的设计上可以给设计师提供一定的创作灵感。本实例为读者详细讲解如何使用文生图绘制穿着机械装甲的女孩角色图像,图2-34所示为本实例制作完成的图像效果。

图2-34

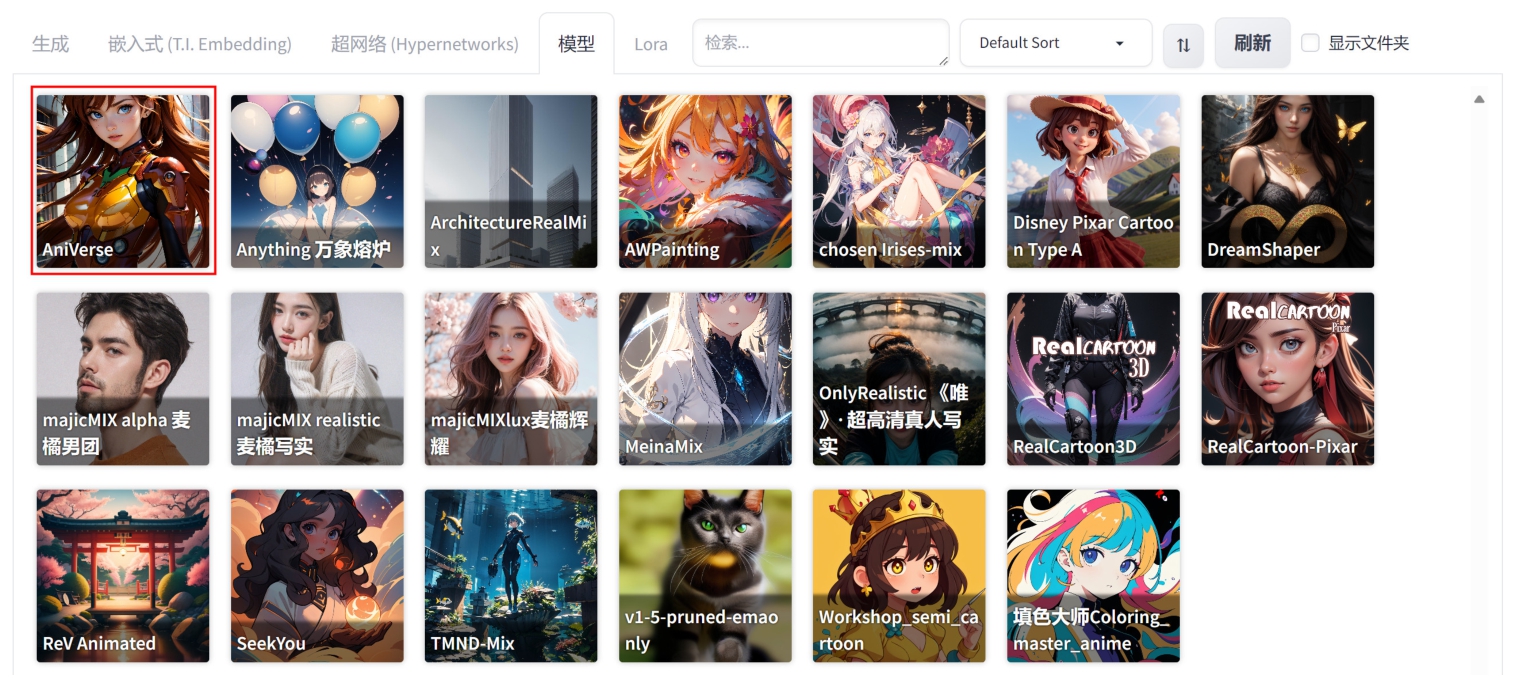

01 在“模型”选项卡中,单击“AniVerse”模型,如图2-35所示,将其设置为“Stable Diffusion模型”。

图2-35

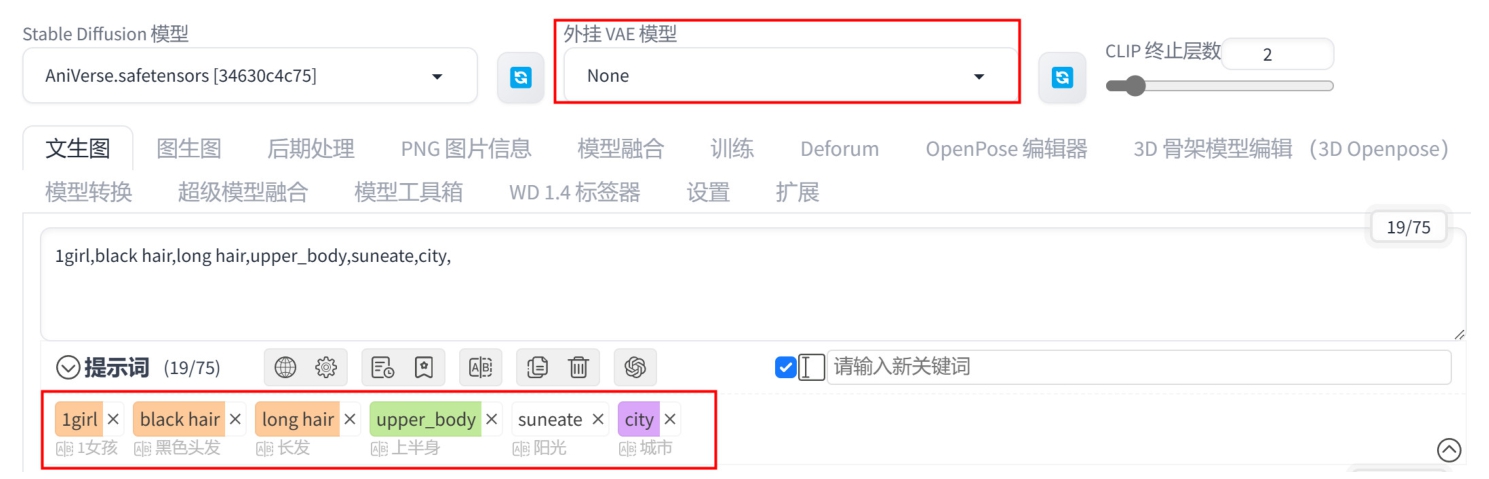

02 设置“外挂VAE模型”为None(无),并输入中文提示词“1女孩,黑色头发,长发,上半身,阳光,城市”,按Enter键,即可将其翻译为英文“1girl,black hair,long hair,upper_body,suneate,city,”,并自动填入正向提示词文本框内,如图2-36所示。

03 补充英文提示词“dressing high detailed Evangelion red suit”,翻译成中文为“着装高细节新世纪福音战士红色套装”,如图2-37所示。使用该提示词可以绘制出类似该动画片角色服装风格的衣服效果。

图2-36

图2-37

读者可以尝试分别使用该模型作者提供的提示词来得到不同风格的机械装甲效果。例如,dressing high detailed Evangelion red suit(着装高细节新世纪福音战士红色套装),dressing high detailed Evangelion white suit(着装高细节新世纪福音战士白色套装),in spiderman suit(蜘蛛侠套装),medieval gold armor(中世纪黄金盔甲)。

此外,当我们使用作者提供的英文提示词时,直接使用英文更为准确。

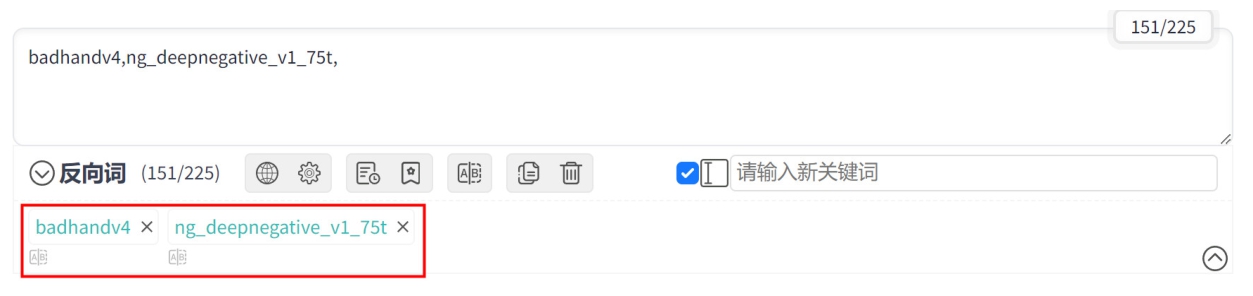

04 在“嵌入式(T.I.Embedding)”卷展栏中,单击“badhandv4”和“ng_deepnegative_v1_75t”模型,如图2-38所示,将其添加至反向词文本框中,如图2-39所示。

图2-38

图2-39

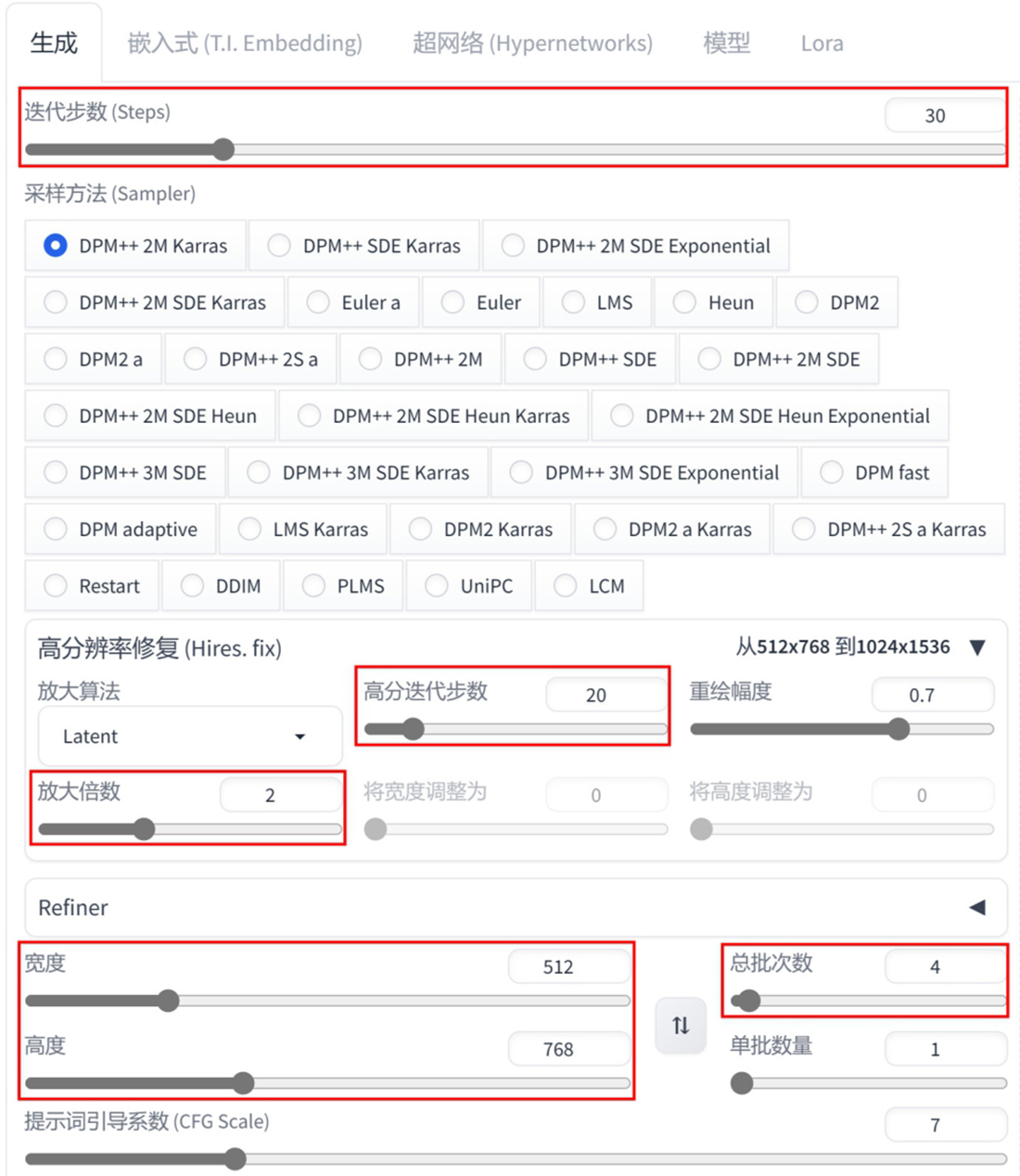

05 在“生成”选项卡中,设置“迭代步数(Steps)”为40、“高分迭代步数”为20、“放大倍数”为2、“宽度”为512、“高度”为768、“总批次数”为4,如图2-40所示。

图2-40

06 设置完成后,生成的图像结果如图2-41所示,可以看到这些图像的效果基本符合之前所输入的提示词。

图2-41

07 在反向词文本框内输入“正常质量,最差质量,低质量,低分辨率”,按Enter键,即可将其翻译为英文“normal quality,worstquality,low quality,lowres,”,并提高这些反向提示词的权重,如图2-42所示。

图2-42

08 设置完成后,重绘图像,生成的图像结果如图2-43所示,可以看到画面中角色的面容及衣服的细节有了明显的质量提升。

图2-43

使用Stable Diffusion配合合适的模型可以绘制出非常写实的人物角色,本实例为读者讲解如何创建一个男性角色所需要的提示词,图2-44所示为本实例制作完成的图像结果。

图2-44

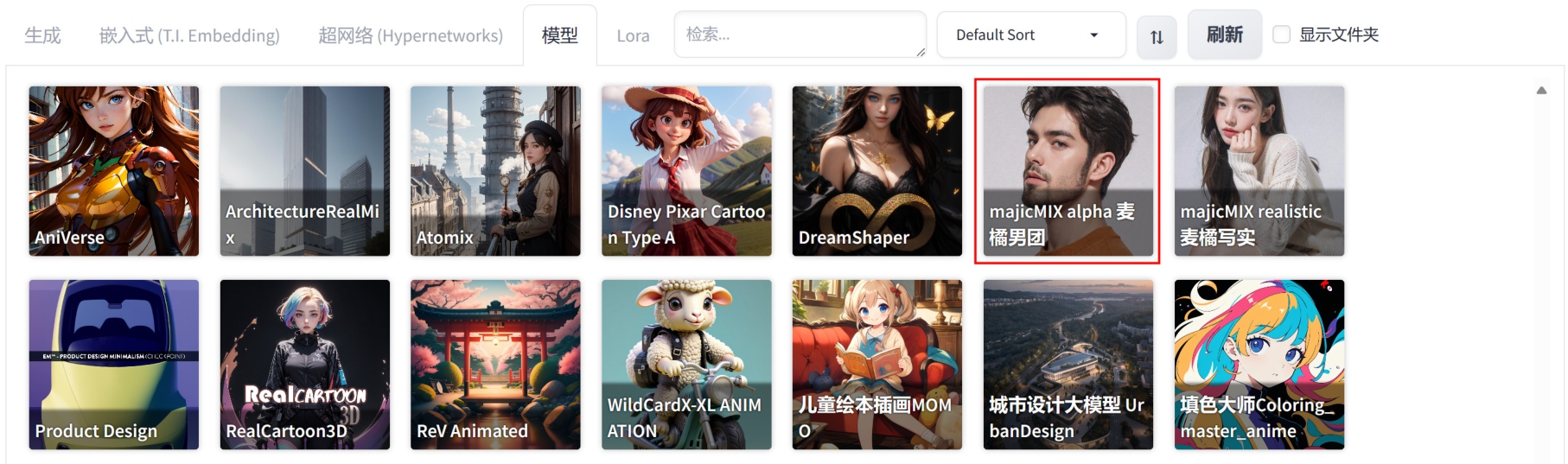

01 在“模型”选项卡中,单击“majicMIX alpha麦橘男团”模型,如图2-45所示,将其设置为“Stable Diffusion模型”。

02 设置“外挂VAE模型”为None(无),并输入中文提示词“男生,黑色头发,微笑,侧脸,灰色背景,上半身,T恤,大块肌肉”后,按Enter键则可以生成对应的英文“schoolboy,black hair,smile,side face,grey_background,upper_body,t-shirt,large muscle mass,”,如图2-46所示。

图2-45

图2-46

03 在“生成”选项卡中,设置“迭代步数(Steps)”为30、“高分迭代步数”为20、“放大倍数”为2、“宽度”为512、“高度”为768、“总批次数”为4,如图2-47所示。

图2-47

04 设置完成后,生成的图像结果如图2-48所示,可以看到这些图像的效果基本符合之前所输入的提示词,但是角色的皮肤看起来缺乏细节。

图2-48

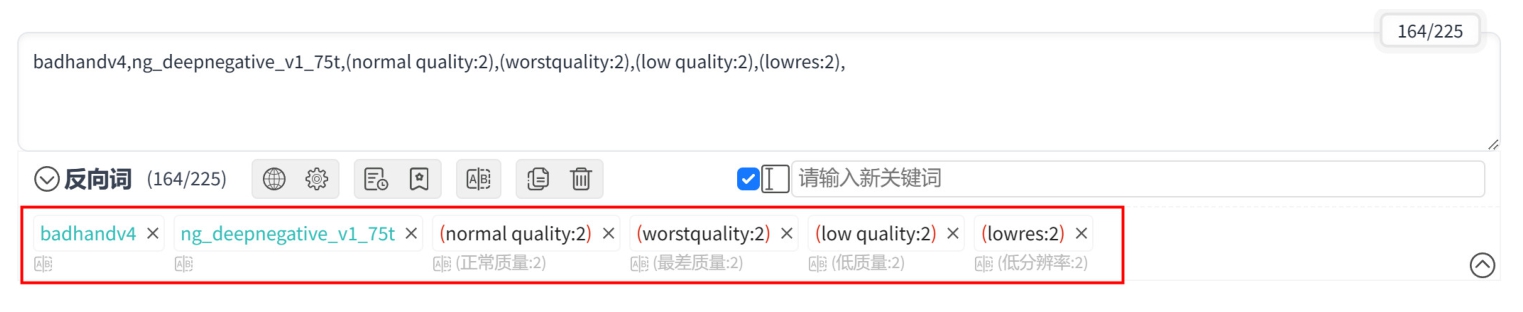

05 在“嵌入式(T.I.Embedding)”卷展栏中,单击“badhandv4”和“ng_deepnegative_v1_75t”模型,如图2-49所示,将其添加至反向词文本框中。在反向词文本框内补充提示词“正常质量,最差质量,低质量,低分辨率”,按Enter键,即可将其翻译为英文“normal quality,worstquality,low quality,lowres,”,并提高这些反向提示词的权重,如图2-50所示。

图2-49

图2-50

06 设置完成后,绘制出来的效果如图2-51所示。可以看到这4幅图像中无论是角色的皮肤质感还是服装上的细节均提升了许多。

图2-51

本实例为读者讲解如何创建一个可爱动物角色所需要的提示词,图2-52所示为本实例制作完成的图像结果。

图2-52

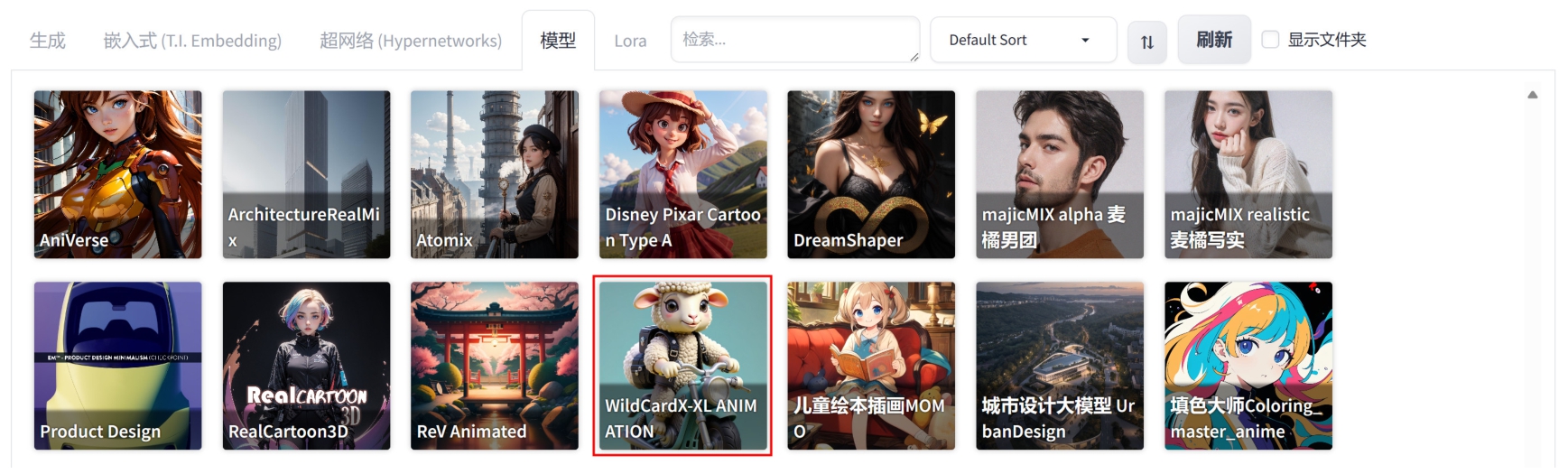

01 在“模型”选项卡中,单击“WildCardX-XL ANIMATION”模型,如图2-53所示,将其设置为“Stable Diffusion模型”。

图2-53

读者需注意,如果该模型的名称中有XL字样,说明该模型可以直接绘制更大尺寸的图像,同时,这类模型的文件大小通常也更大,并且需要更高性能的计算机来支持。

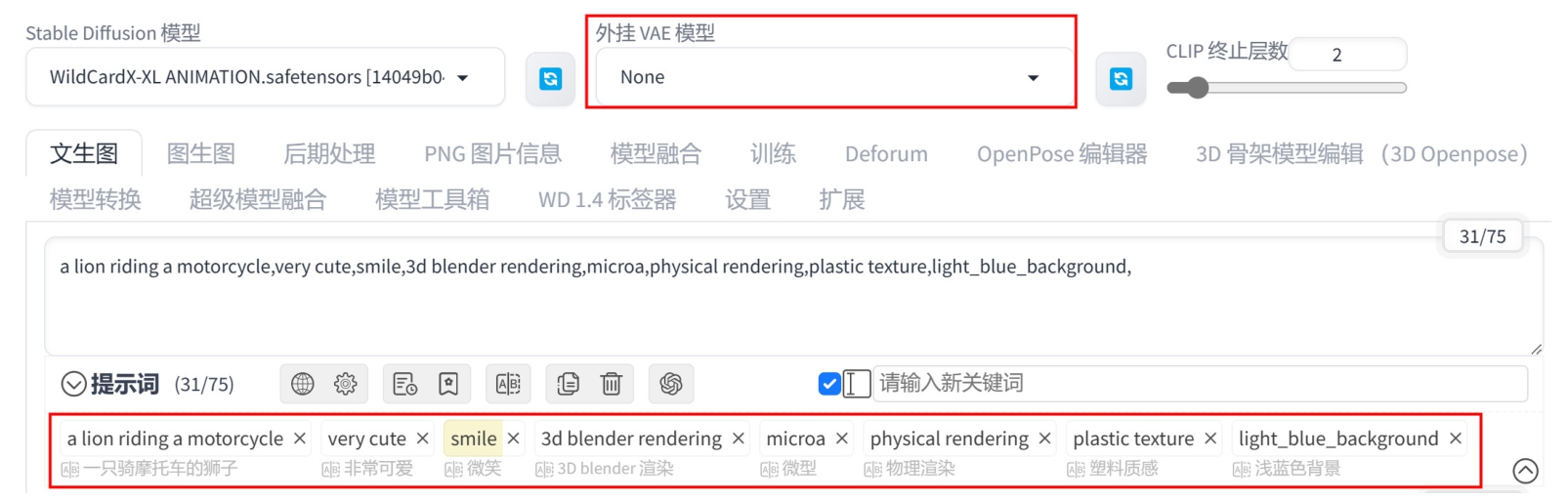

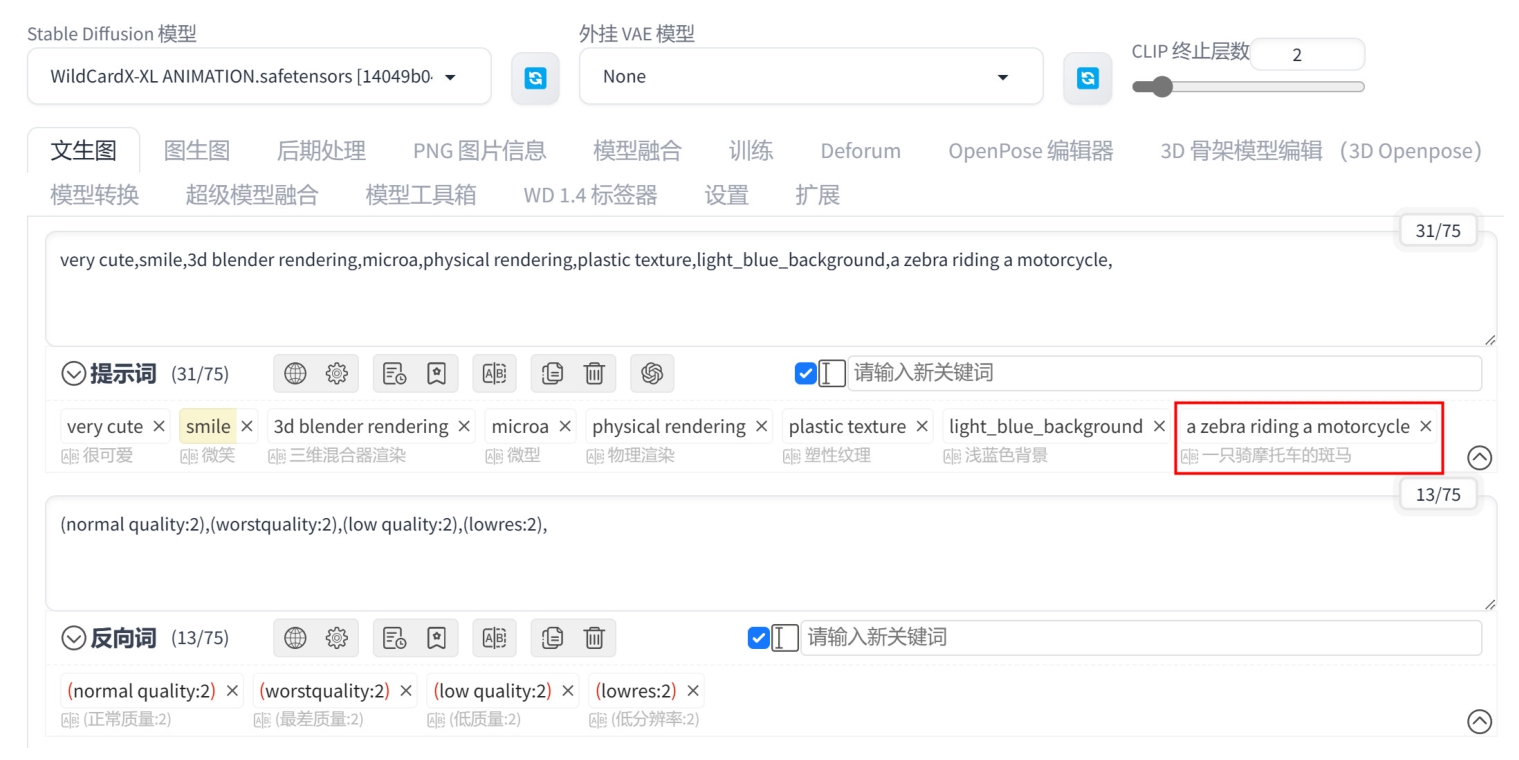

02 设置“外挂VAE模型”为None(无),并输入中文提示词“一只骑摩托车的狮子,非常可爱,微笑,3D blender渲染,微型,物理渲染,塑料质感,浅蓝色背景”后,按Enter键则可以生成对应的英文“a lion riding a motorcycle,very cute,smile,3d blender rendering,microa,physical rendering,plastic texture,light_blue_background,”,如图2-54所示。

图2-54

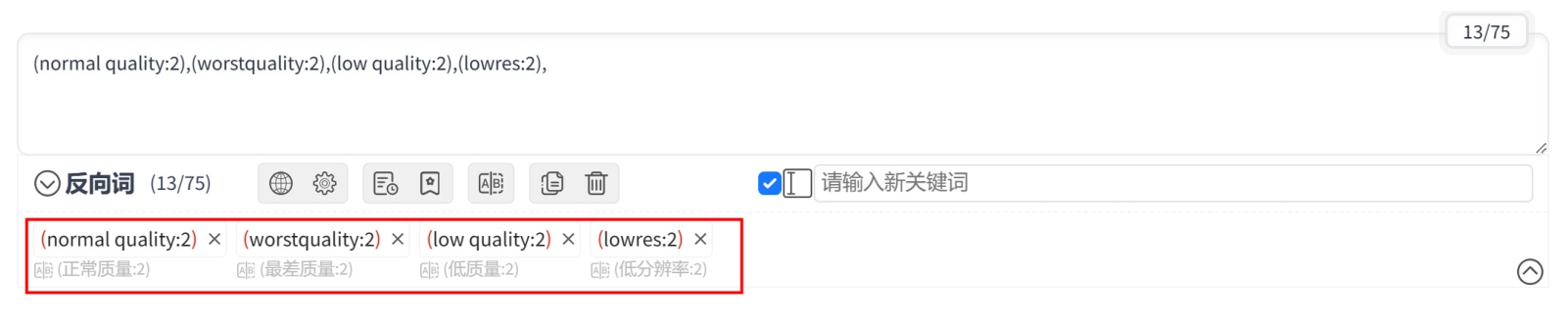

03 在反向词文本框内输入“正常质量,最差质量,低质量,低分辨率”,按Enter键,即可将其翻译为英文“normal quality,worstquality,low quality,lowres,”,并提高这些反向提示词的权重,如图2-55所示。

图2-55

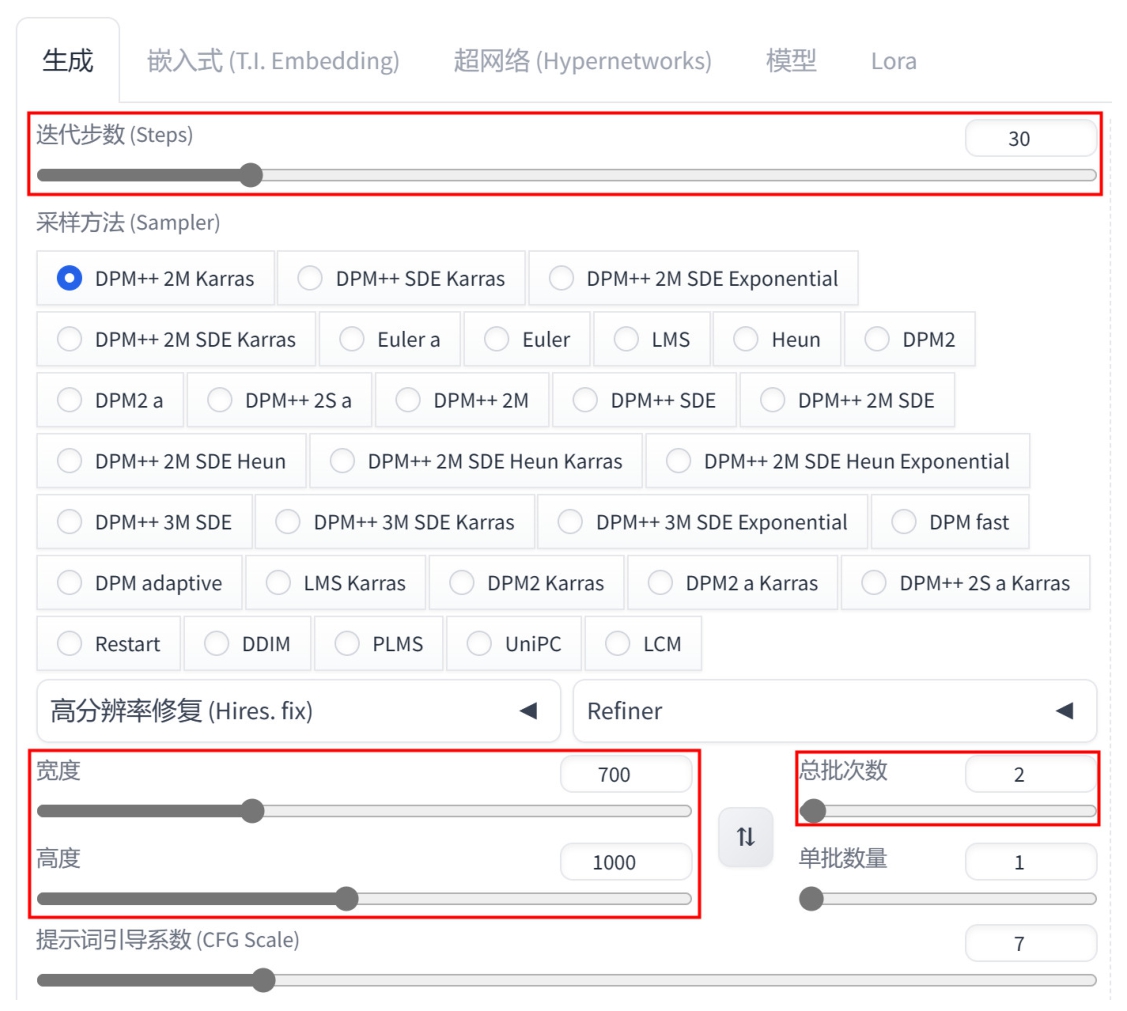

04 在“生成”选项卡中,设置“迭代步数(Steps)”为30、“宽度”为700、“高度”为1000、“总批次数”为2,如图2-56所示。

05 设置完成后,绘制出来的效果如图2-57所示,可以看到这些图像的效果基本符合之前所输入的提示词。

06 将“一只骑摩托车的狮子”一词删除,补充正向提示词“一只骑摩托车的斑马”,对应的英文为“a zebra riding a motorcycle”,如图2-58所示。

07 设置完成后,重绘图像,绘制出来的效果如图2-59所示,读者可以观察新添加提示词对画面的改变效果。

图2-56

图2-57

图2-58

图2-59

本实例为读者讲解如何创建一个色彩斑斓的二维女孩形象,图2-60所示为本实例制作完成的图像结果。

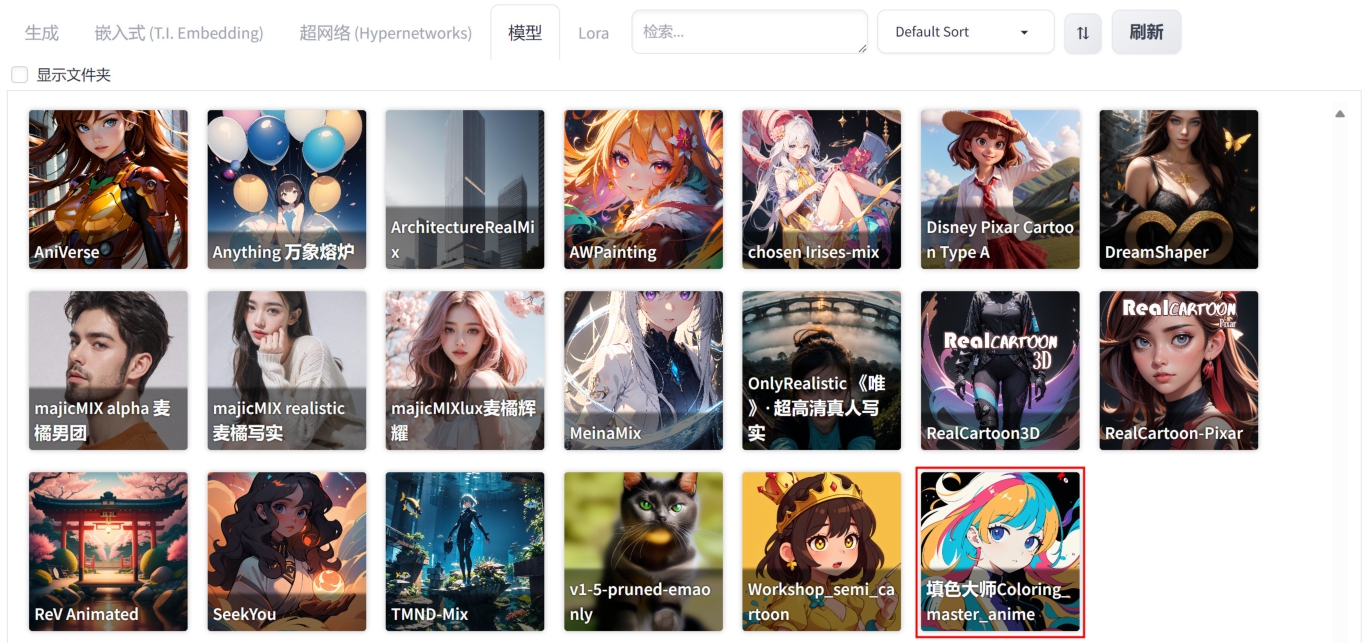

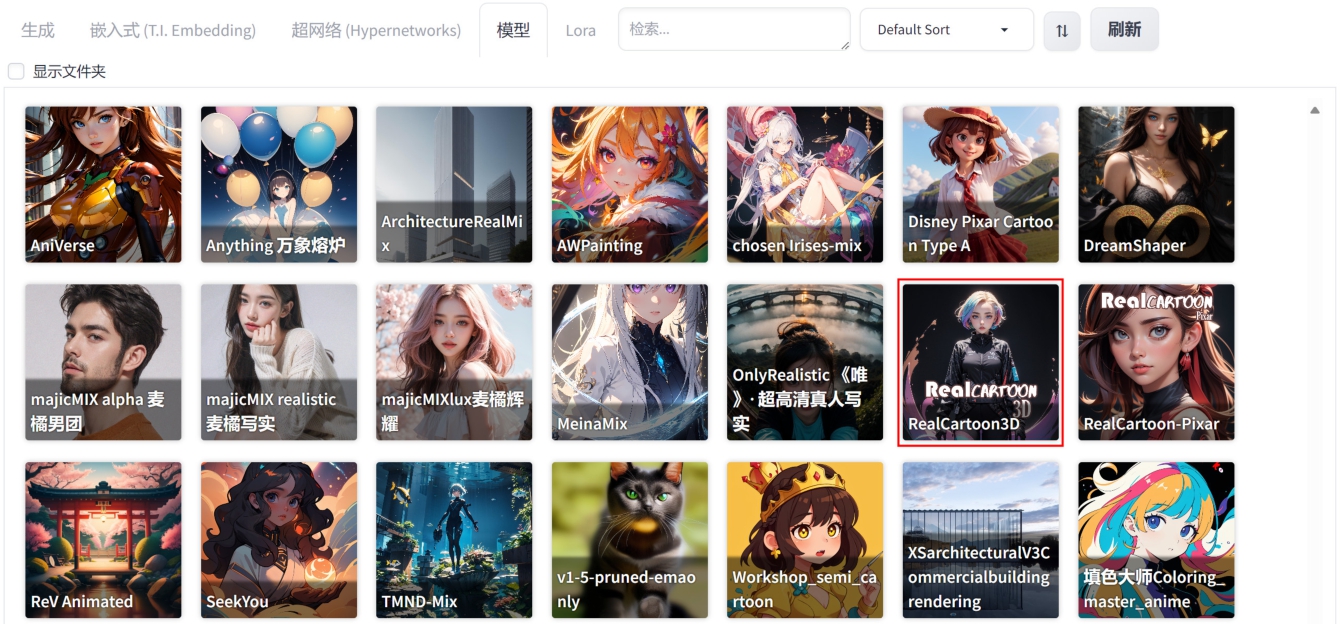

01 在“模型”选项卡中,单击“填色大师Coloring_master_anime”模型,如图2-61所示,将其设置为“Stable Diffusion模型”。

图2-60

图2-61

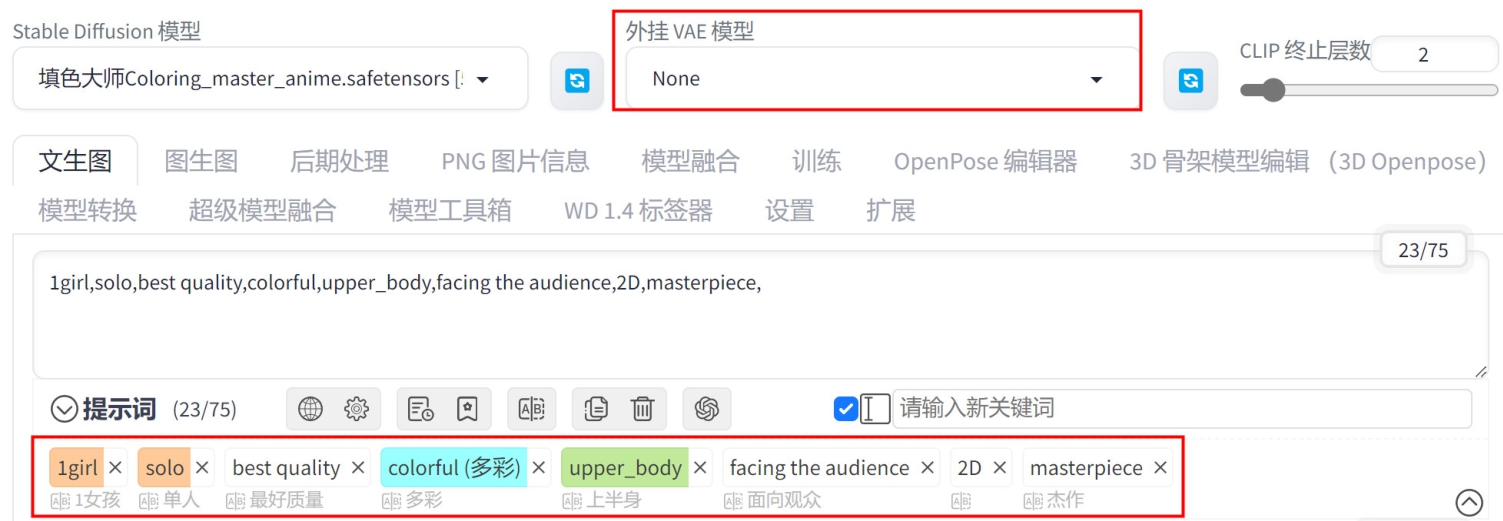

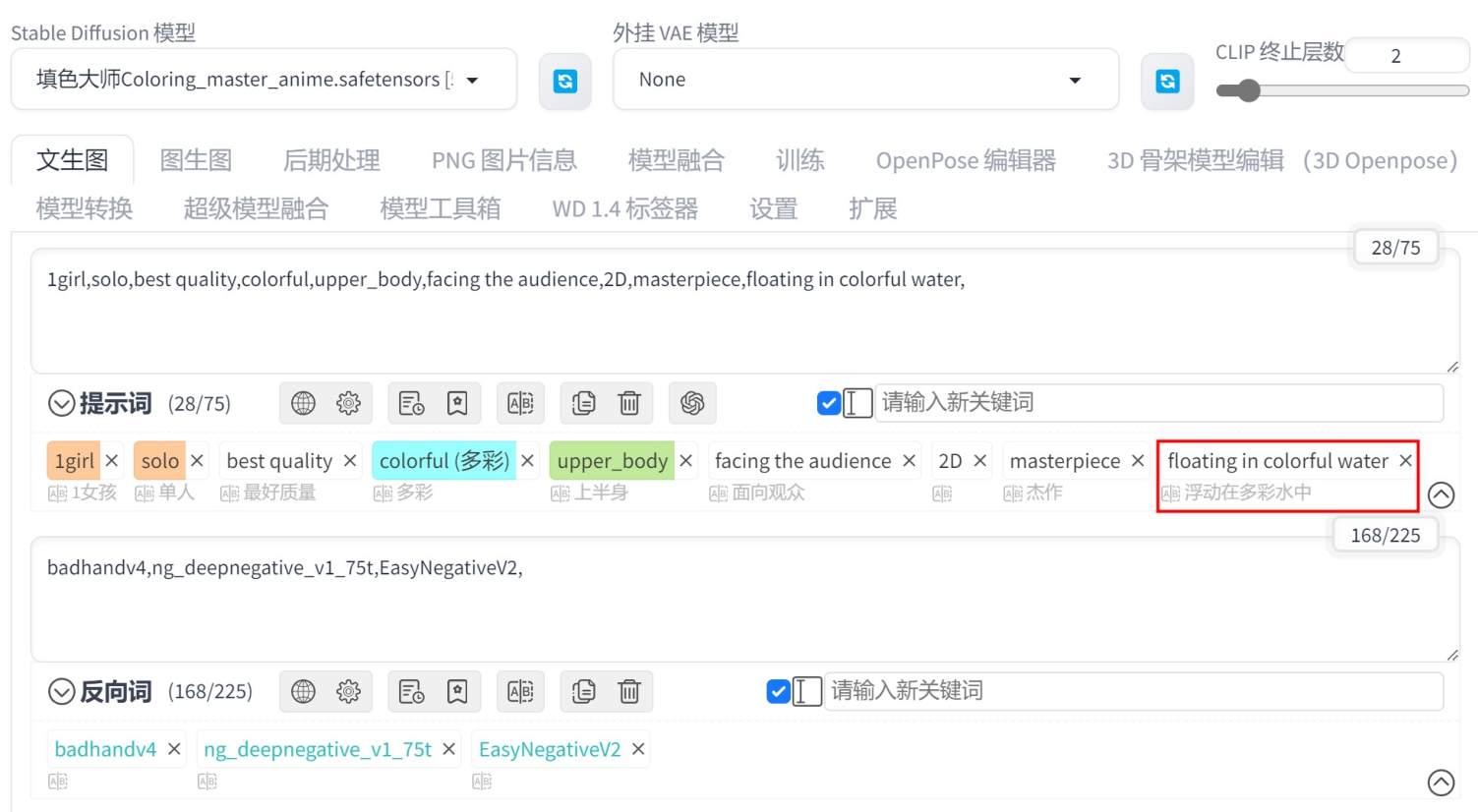

02 设置“外挂VAE模型”为None(无),并输入中文提示词“1女孩,单人,最好质量,多彩,上半身,面向观众,2D,杰作”后,按Enter键则可以生成对应的英文“1girl,solo,best quality,colorful,upper_body,facing the audience,2D,masterpiece,”,如图2-62所示。

图2-62

图2-63

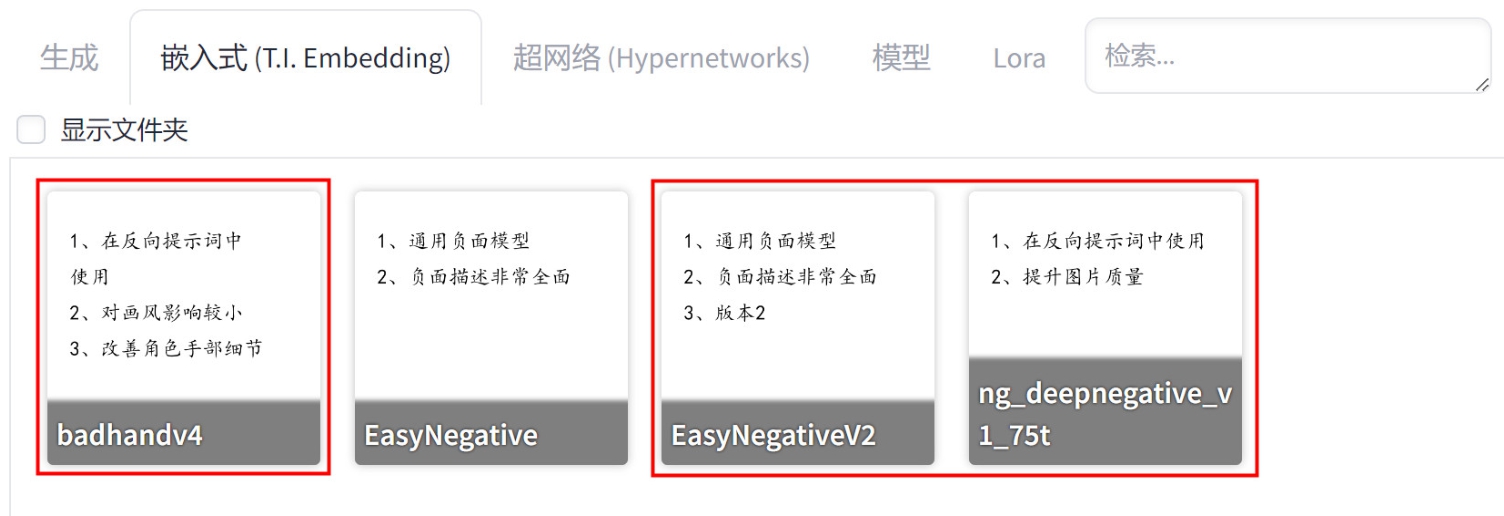

03 在“嵌入式(T.I.Embedding)”卷展栏中,单击“badhandv4”“EasyNegativeV2”和“ng_deepnegative_v1_75t”模型,如图2-63所示,将其添加至反向词文本框中,如图2-64所示。

图2-64

04 在“生成”选项卡中,设置“迭代步数(Steps)”为30、“高分迭代步数”为20、“放大倍数”为1.5、“宽度”为700、“高度”为1000、“总批次数”为4,如图2-65所示。

图2-65

05 设置完成后,绘制出来的效果如图2-66所示,可以看到这些图像的效果基本符合之前所输入的提示词。

图2-66

06 现在补充正向提示词“浮动在多彩的水中”,翻译为英文“floating in colorful water”,如图2-67所示。

图2-67

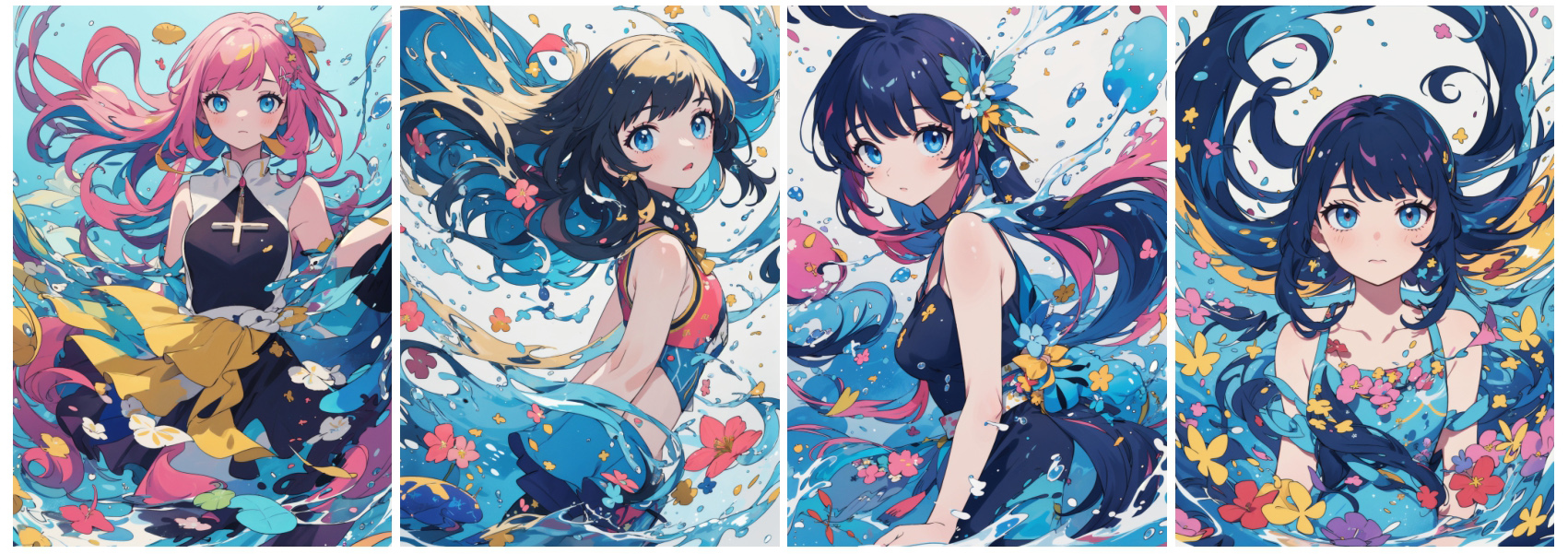

07 设置完成后,绘制出来的效果如图2-68所示,可以看到这4幅图像中的色彩丰富了许多。

图2-68

本实例为读者详细讲解如何使用文生图绘制乘坐地铁的女孩角色图像,图2-69所示为本实例制作完成的图像结果。

01 在“模型”选项卡中,单击“RealCartoon3D”模型,如图2-70所示,将其设置为“Stable Diffusion模型”。

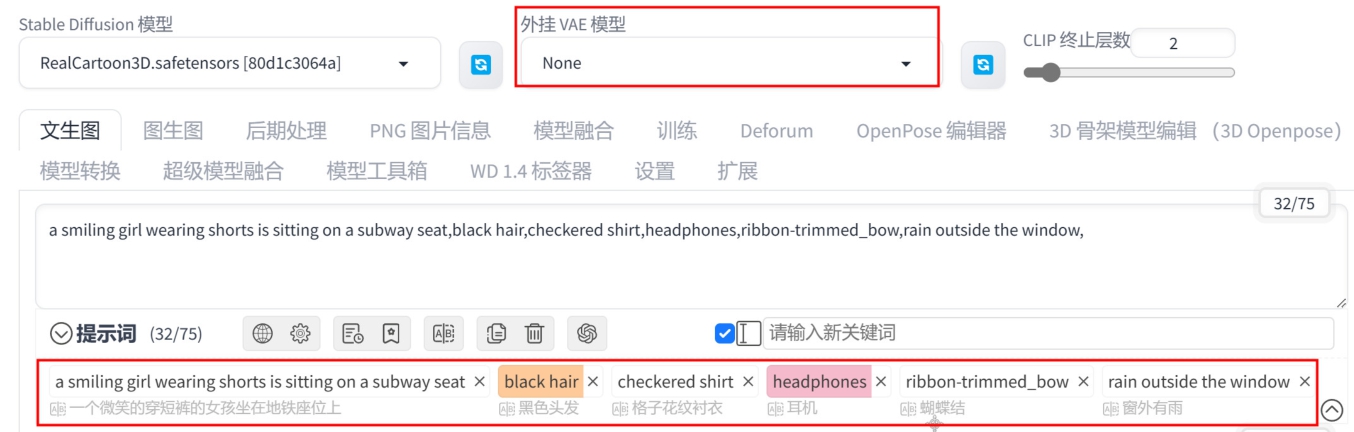

02 设置“外挂VAE模型”为None(无),并在“文生图”选项卡中输入中文提示词“一个微笑的穿短裤的女孩坐在地铁座位上,黑色头发,格子花纹衬衣,耳机,蝴蝶结,窗外有雨”后,按Enter键则可以生成对应的英文“a smiling girl wearing shorts is sitting on a subway seat,black hair,checkered shirt,headphones,ribbontrimmed_bow,rain outside the window,”,如图2-71所示。

图2-69

图2-70

图2-71

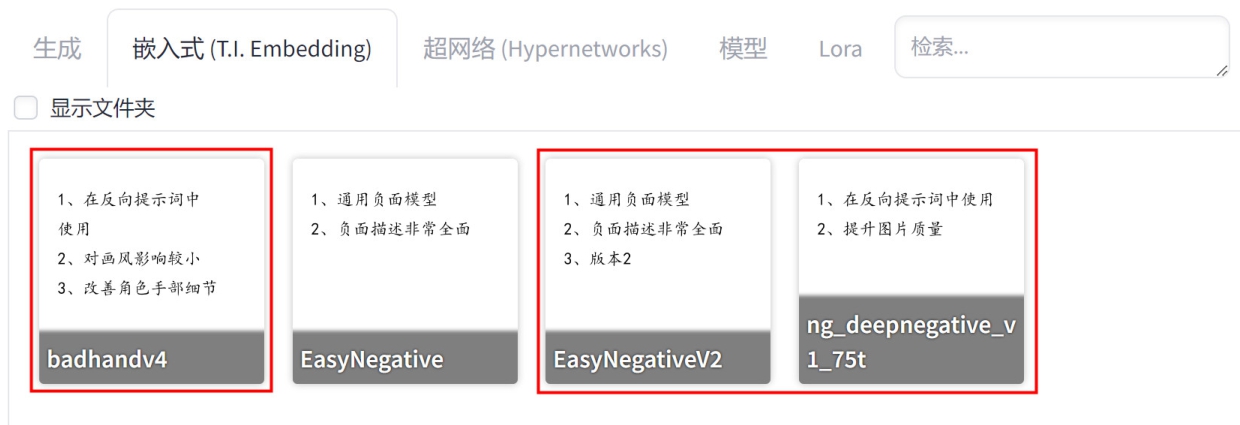

03 在“嵌入式(T.I.Embedding)”卷展栏中,单击“badhandv4”“EasyNegativeV2”和“ng_deepnegative_v1_75t”模型,如图2-72所示,将其添加至反向词文本框中,如图2-73所示。

图2-72

图2-73

04 在“生成”选项卡中,设置“迭代步数(Steps)”为50、“高分迭代步数”为20、“放大倍数”为2、“宽度”为512、“高度”为768、“总批次数”为4,如图2-74所示。

图2-74

05 设置完成后,绘制出来的效果如图2-75所示,可以看到这些图像的效果基本符合之前所输入的提示词。

图2-75

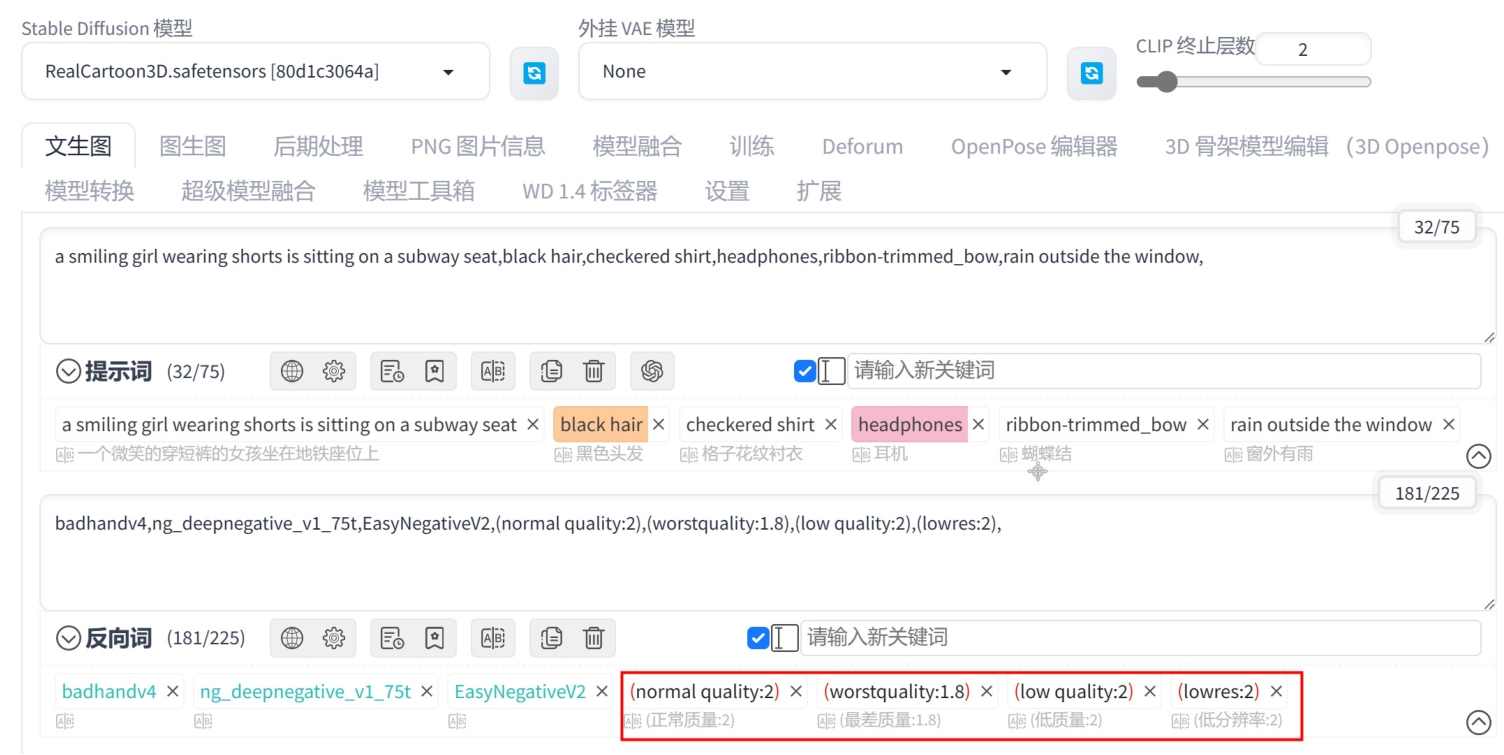

06 在反向词文本框内输入“正常质量,最差质量,低质量,低分辨率”,按Enter键,即可将其翻译为英文“normal quality,worstquality,low quality,lowres,”,并提高这些反向提示词的权重,如图2-76所示。

07 设置完成后,绘制出来的效果如图2-77所示,可以看到整个图像的质量提升了许多。

图2-76

图2-77

AI绘画不仅可以以文生图的方式绘制出各种各样的角色,还可以绘制出极具未来科幻色彩的楼房景观效果。本实例为读者详细讲解如何使用文生图绘制楼房景观效果图,图2-78所示为本实例制作完成的图像结果。

图2-78

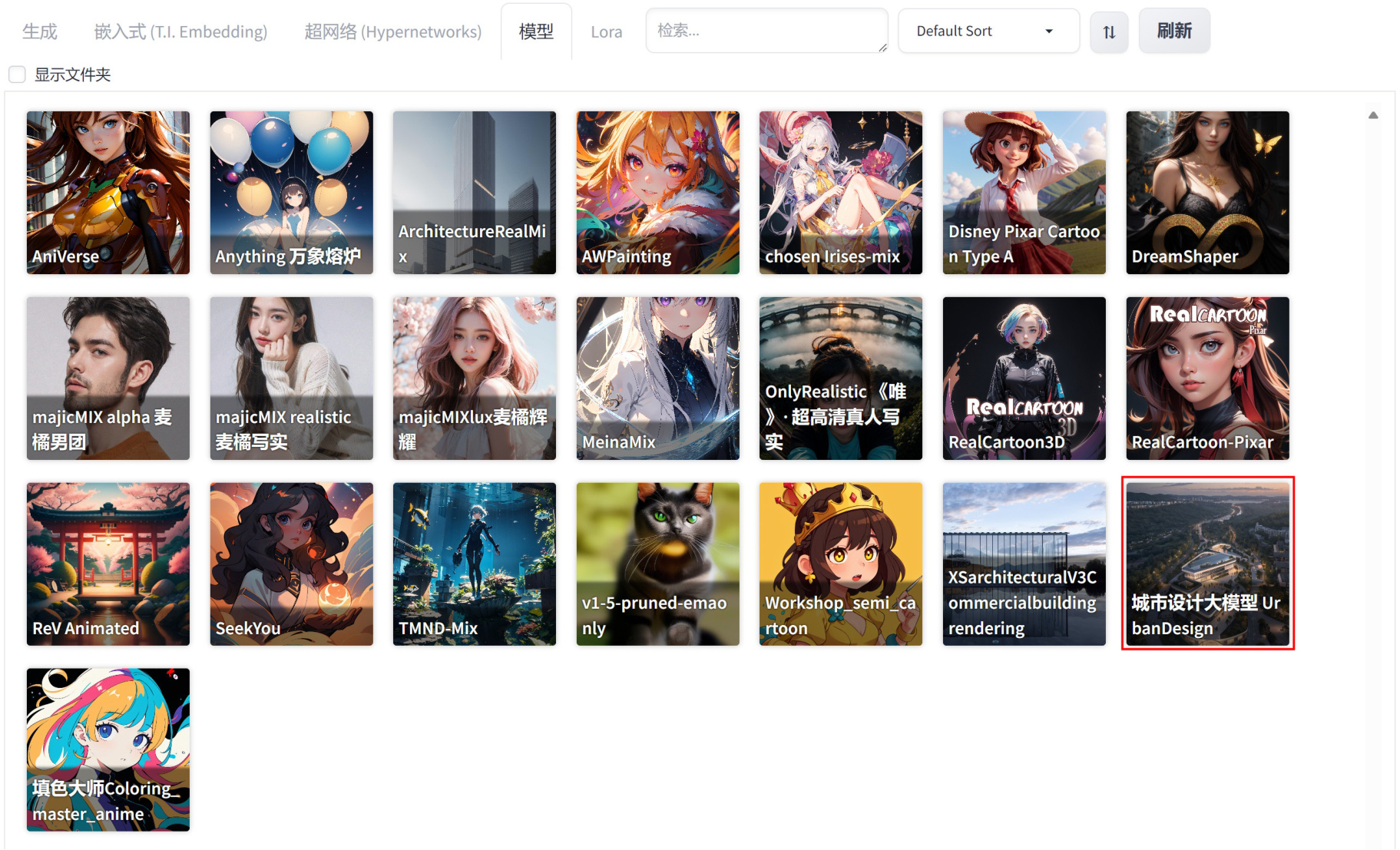

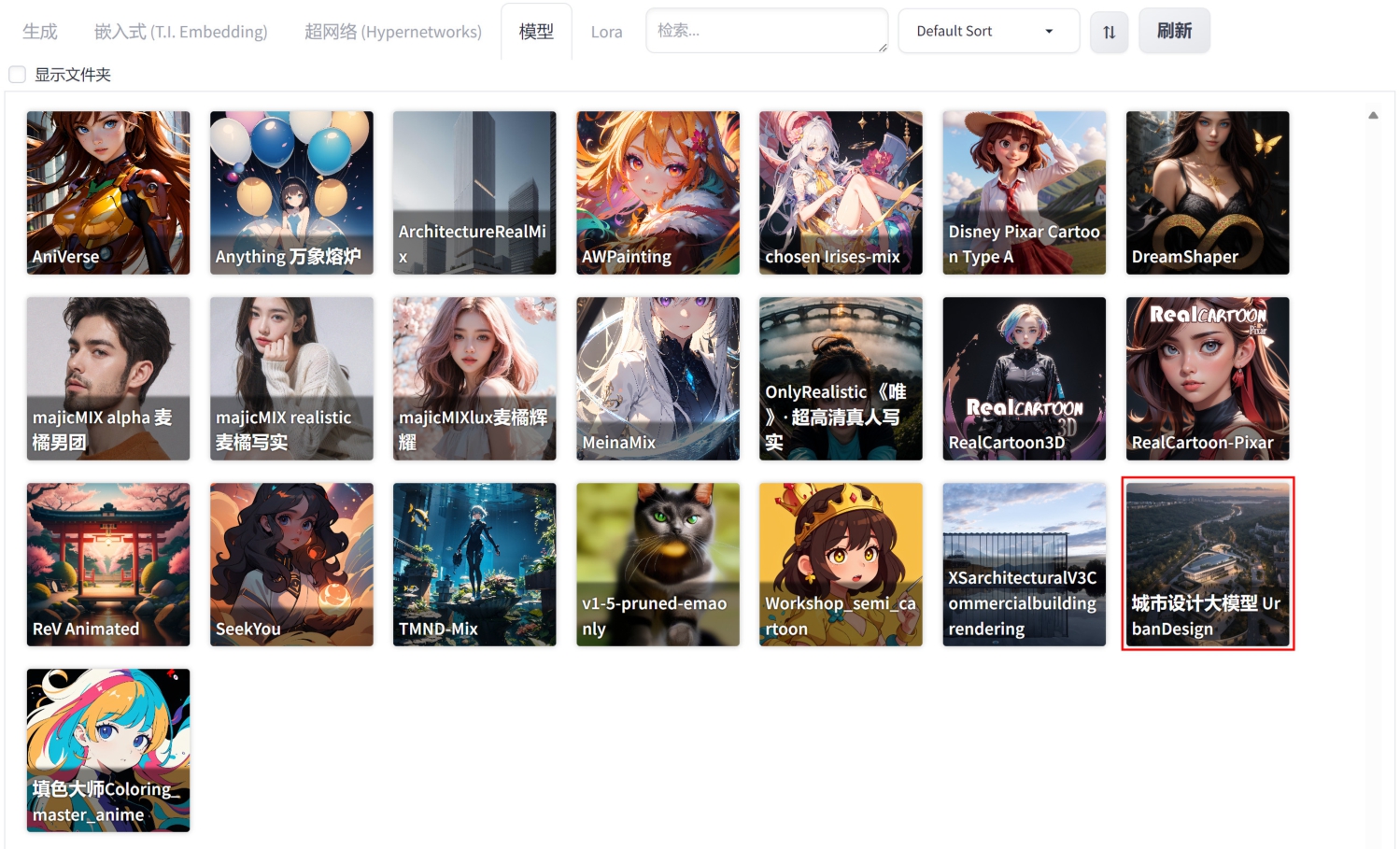

01 在“模型”选项卡中,单击“城市设计大模型UrbanDesign”模型,如图2-79所示,将其设置为“Stable Diffusion模型”。

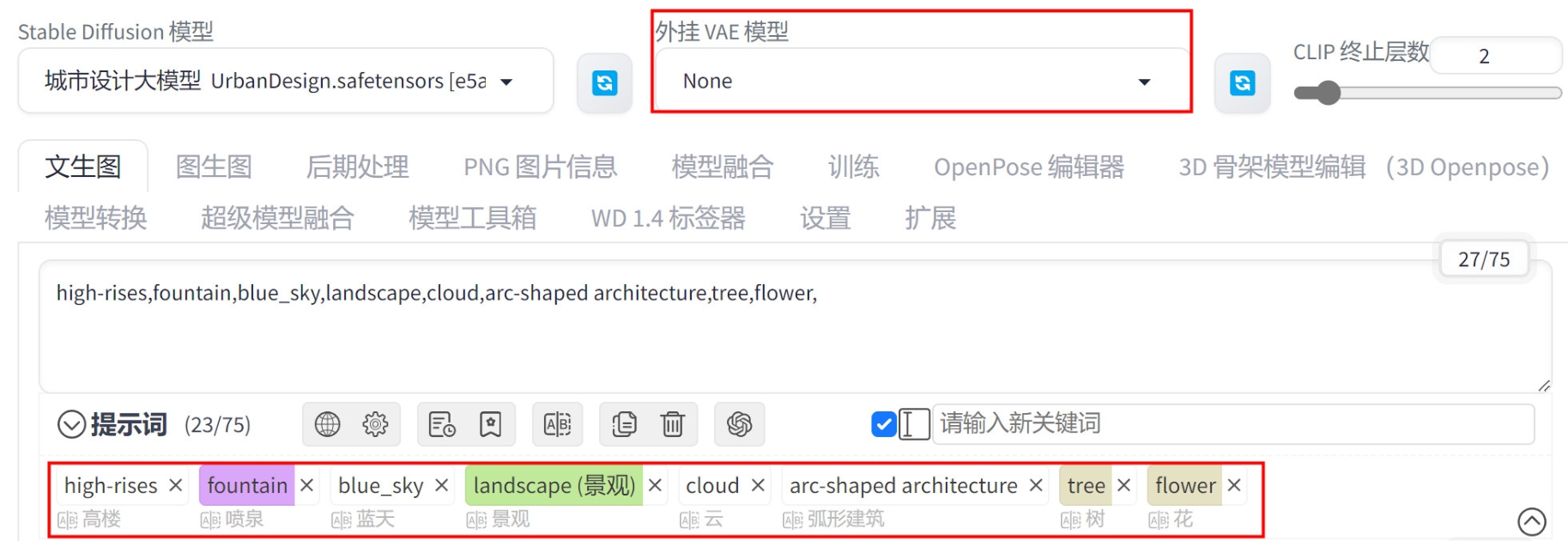

图2-79

02 设置“外挂VAE模型”为None,并输入中文提示词“高楼,喷泉,蓝天,景观,云,弧形建筑,树,花”,按Enter键,即可将其翻译为英文“high-rises,fountain,blue_sky,landscape,cloud,arc-shaped architecture,tree,flower,”,并自动填入正向提示词文本框内,如图2-80所示。

图2-80

03 在“生成”选项卡中,设置“迭代步数(Steps)”为50、“高分迭代步数”为20、“放大倍数”为1.5、“宽度”为700、“高度”为1000、“总批次数”为4,如图2-81所示。

04 设置完成后,绘制出来的效果如图2-82所示,可以看到这些图像的效果基本符合之前所输入的提示词。

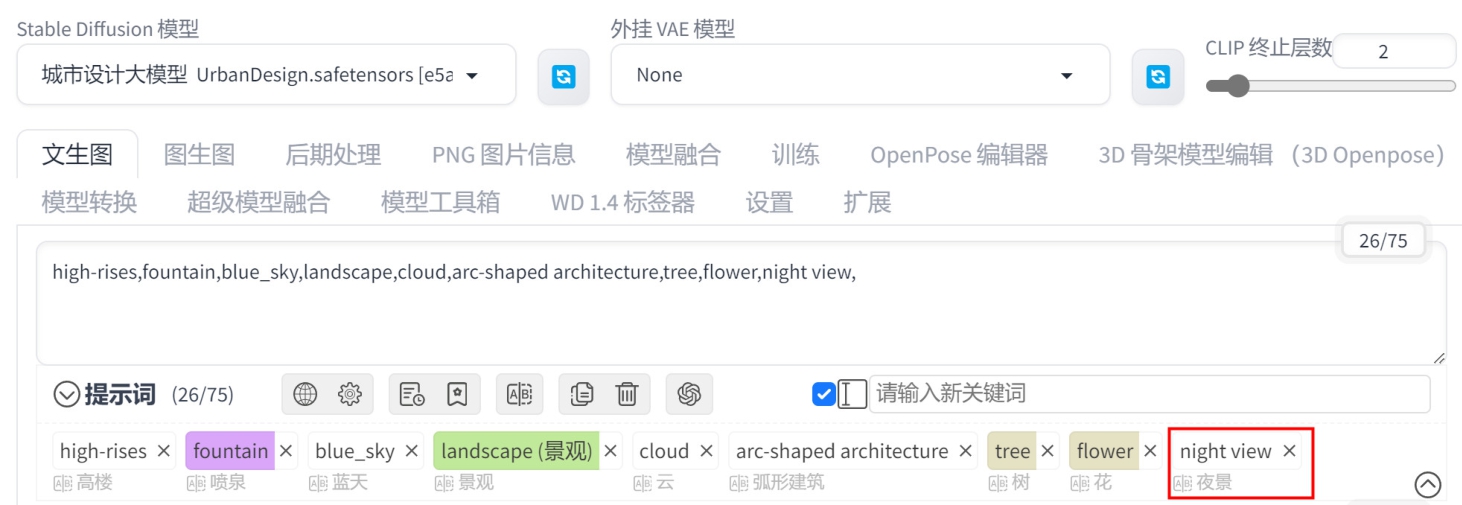

05 现在补充正向提示词“夜景”,翻译为英文“night view,”,如图2-83所示。

06 再次重新绘制图像,如图2-84所示,可以看到增加了“夜景”提示词后的效果图变为了夜景效果。

图2-81

图2-82

图2-83

图2-84

本实例为读者详细讲解如何使用文生图绘制多幅小区日景的效果图,图2-85所示为本实例制作完成的图像结果。读者学习本章时,可以对比上一章中提示词的变化。

图2-85

01 在“模型”选项卡中,单击“城市设计大模型UrbanDesign”模型,如图2-86所示,将其设置为“Stable Diffusion模型”。

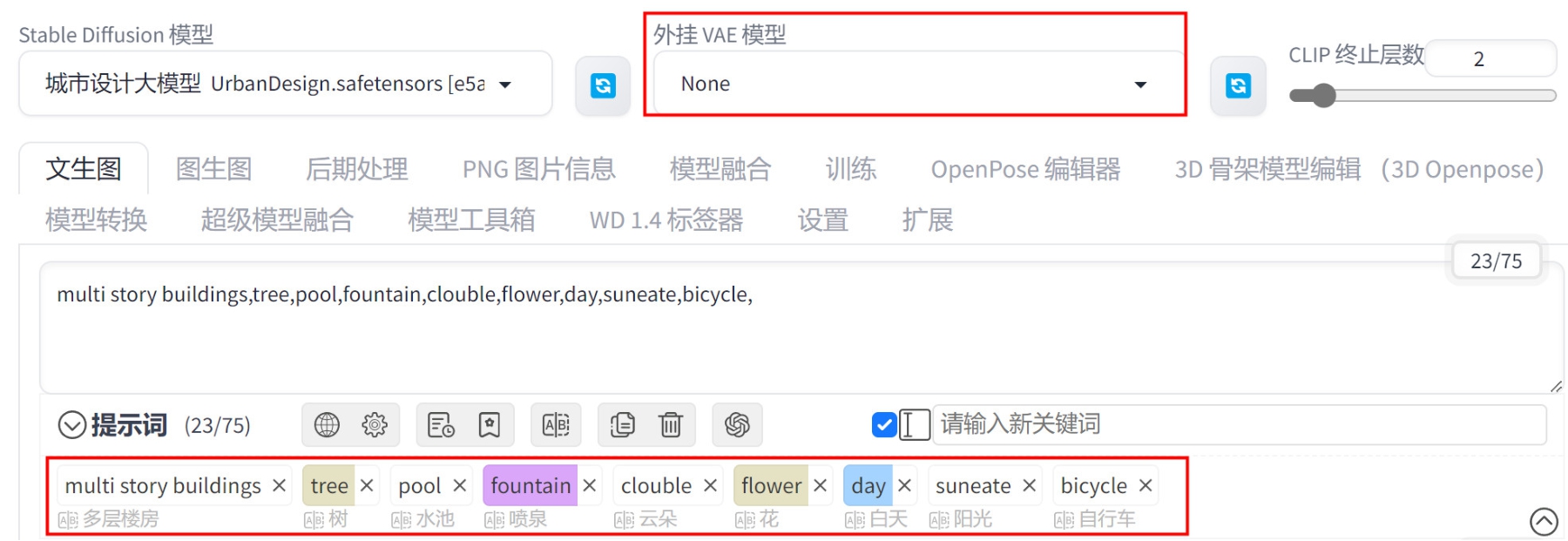

图2-86

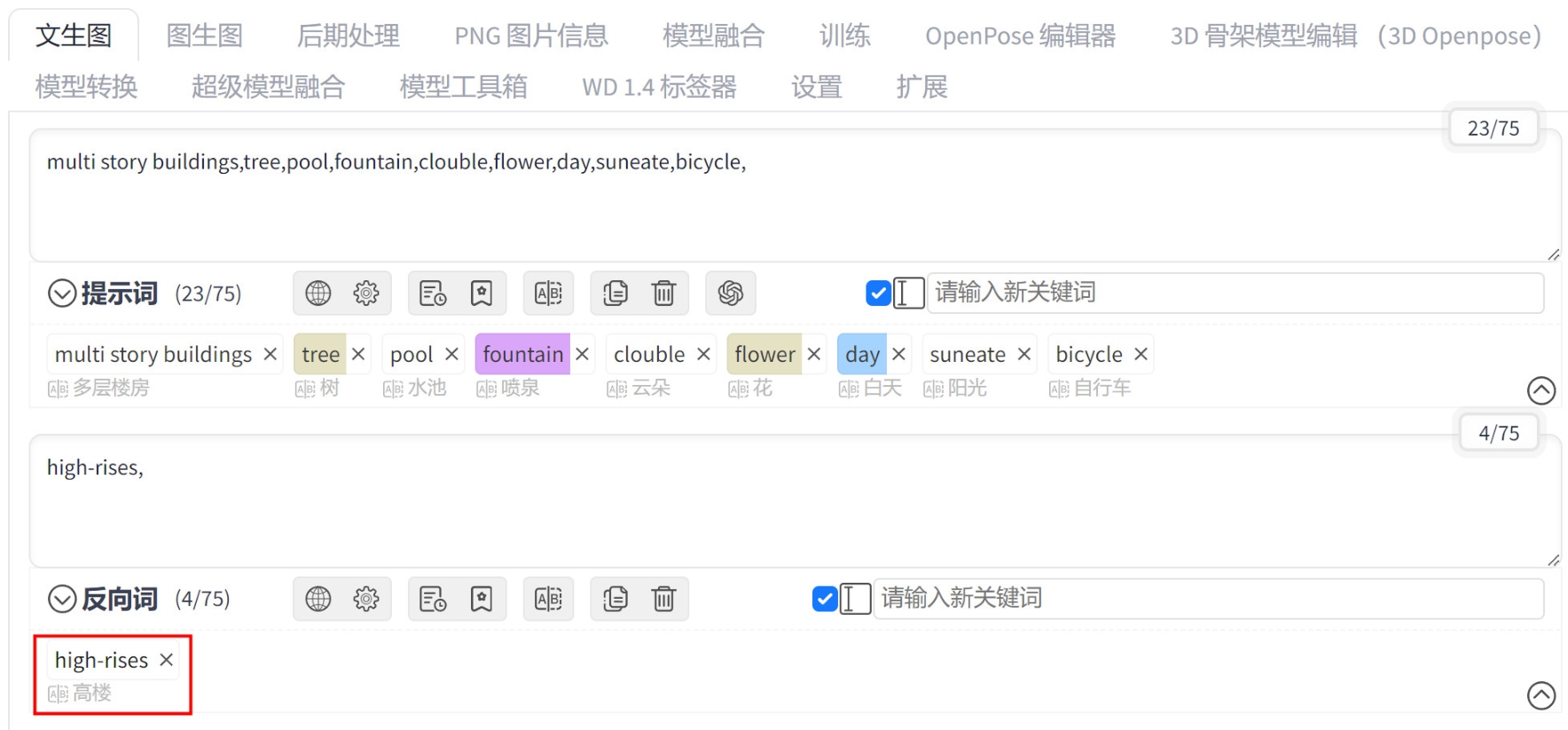

02 设置“外挂VAE模型”为None,并输入中文提示词“多层楼房,树,水池,喷泉,云朵,花,白天,阳光,自行车”,按Enter键,即可将其翻译为英文“multi story buildings,tree,pool,fountain,clouble,flower,day,suneate,bicycle,”,并自动填入正向词文本框内,如图2-87所示。

图2-87

03 在反向词文本框内输入中文提示词“高楼”后,按Enter键则可以生成对应的英文“high-rise”,如图2-88所示。

图2-88

04 在“生成”选项卡中,设置“迭代步数(Steps)”为50、“高分迭代步数”为20、“放大倍数”为1.5、“宽度”为1000、“高度”为700、“总批次数”为4,如图2-89所示。

05 设置完成后,绘制出来的效果如图2-90所示,可以看到这些图像的效果基本符合之前所输入的提示词,场景也中没有出现特别高的建筑。

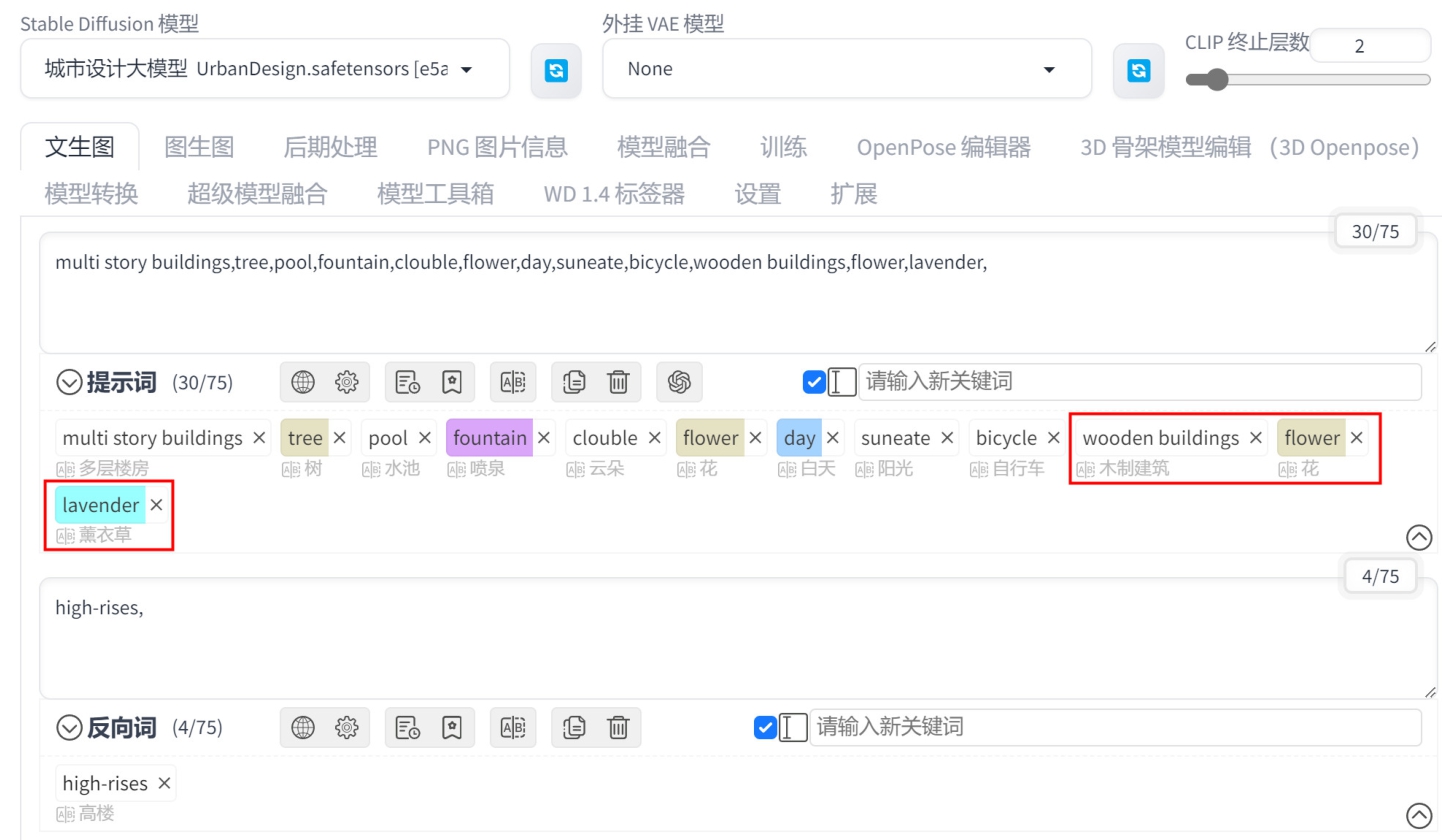

06 现在补充正向提示词“木制建筑,花,薰衣草”,翻译为英文“wooden buildings,flower,lavender,”,如图2-91所示。

图2-89

图2-90

图2-91

07 再次重新绘制图像,这次得到的图像可以看出建筑外立面的材质变化以及场景中明显多了许多花朵,如图2-92所示。

图2-92